最小二乘法解线性回归

发布时间:2024年01月02日

最小二乘法

算法介绍

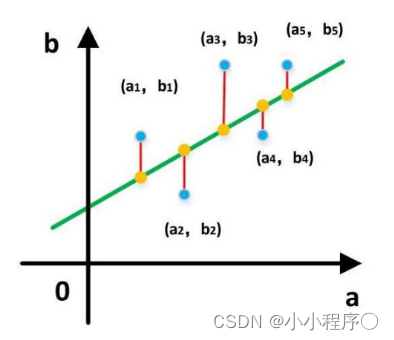

基于均方误差最小化来进行模型求解的方法称为“最小二乘法(least square method)它的主要思想就是选择未知参数,(a5,b5)(a3,b3)(a1,b1)(a4,b4)(a2,b2)使得理论值与观测值之差的平方和达到最小。

我们假设输入属性 (特征) 的数目只有一个

在线性回归中,最小二乘法就是试图找到一条直线,使所有样本到直线上的欧式距离之和最小。

最小二乘法求解线性回归

求解w和b,使得 E(w)=(y - zi-)最小化的过程,称为线性回归模型的“最小二乘参数估计

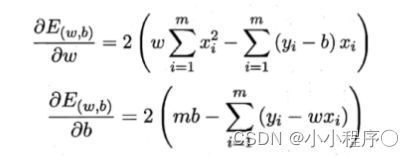

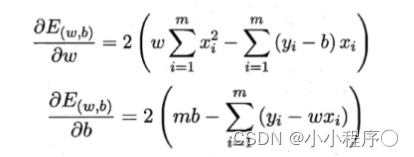

将 E(w,6) 分别对w和b求导,可以得到

令偏导数都为0,可以得到

梯度下降法和最小二乘法

相同点

本质和目标相同:两种方法都是经典的学习算法,在给定已知数据的前提下利用求导算出一个模型(函数),使得损失函数最小,然后对给定的新数据进行估算预测

不同点

损失函数:梯度下降可以选取其它损失函数,而最小二乘一定是平方损失函数实现方法:最小二乘法是直接求导找出全局最小;而梯度下降是一种迭代法效果:最小二乘找到的一定是全局最小,但计算繁琐,且复杂情况下未必有解;梯度下降迭代计算简单,但找到的一般是局部最小,只有在目标函数是凸函数时才是全局最小:到最小点附近时收敛速度会变慢,且对初始点的选择极为敏感

文章来源:https://blog.csdn.net/2201_75381449/article/details/135342262

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Linux之Ubuntu环境Jenkins部署前端项目

- 机器学习之集成学习 XGBoost(eXtreme Gradient Boosting)附代码

- MFC 消息映射机制

- Go语言数据结构(一)双向链表

- 大厂面试必考——字典树(前缀树)及其C++实现

- C# WPF上位机开发(知识产权ip保护)

- 多线程的基本使用与多线程中条件变量的使用——消费者生产者问题实例

- HJ6 质数因子【C语言】

- 多线程(看这一篇就够了,超详细,满满的干货)

- spring中的方法调用重试机制