基于yolov5-master和pyqt5的森林火灾监测软件

项目背景

火灾作为威胁人类生命生产安全的隐患之一,一直是人们关注的重点。传统的火灾监测装置根据温度来检测火灾,不仅灵敏度差,而且反馈时间长,常常会出现消防员收到警报消息时,火室已经无法控制。

森林火灾监测系统的设计与实现是一项基于深度学习技术的创新性研究,旨在通过自动检测和分析森林的图像数据,实时监测和预防森林火灾的发生。我们选择了PyTorch作为主要的深度学习框架,并结合了目标检测领域的主流算法YOLOv5来完成这一任务。

本系统的主要目标是提高火灾检测的准确性和实时性。为了实现这一目标,我们进行了深入的模型研究和技术实现。通过采用YOLOv5算法,我们能够在图像中准确地识别和定位火灾目标,从而有效地检测火灾的发生。同时,我们也进行了模型训练和优化,以提高系统的检测精度和性能。

在系统设计方面,我们采用了PyQt5制作了直观易用的UI界面。这一界面为用户提供了简便的操作方式,只需通过上传森林图像,系统便能自动进行火灾检测,并及时将检测结果展示给用户。这一设计使得即使是不具备专业知识的用户也能轻松利用本系统进行火灾监测。

除了实时检测功能外,本系统还具备以下优势:

首先,我们的系统可以自动分析和处理大量的图像数据,大大提高了检测效率。其次,通过不断优化算法和模型参数,我们可以提高检测的准确性和可靠性,降低误报和漏报的风险。此外,本系统还具备良好的可扩展性,可以根据实际需求添加更多功能和应用场景。

本系统的研究和实现具有重要的现实意义。通过实时监测和预防森林火灾,我们可以保护生态环境、减少自然资源的损失,并降低火灾对社会和经济的影响。此外,本系统的成功应用也为深度学习技术在森林防火领域的应用提供了有益的参考和借鉴。

效果演示

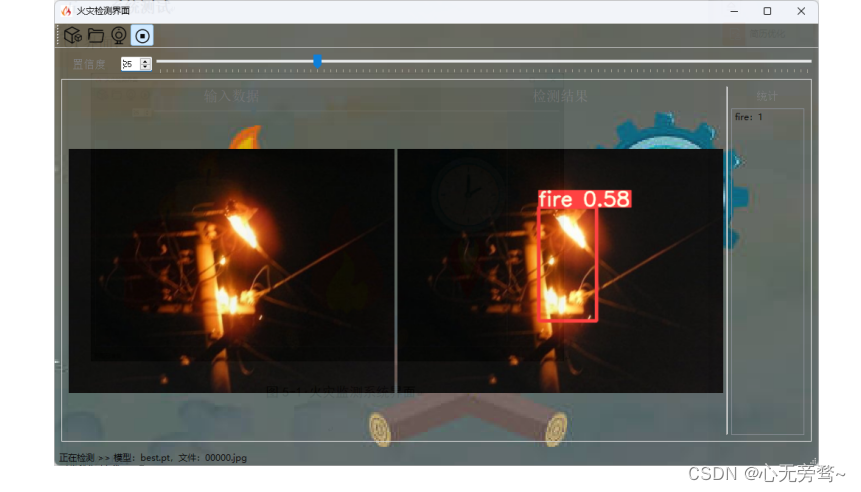

第一版软件界面

单张图片预测结果:

视频流监测效果:

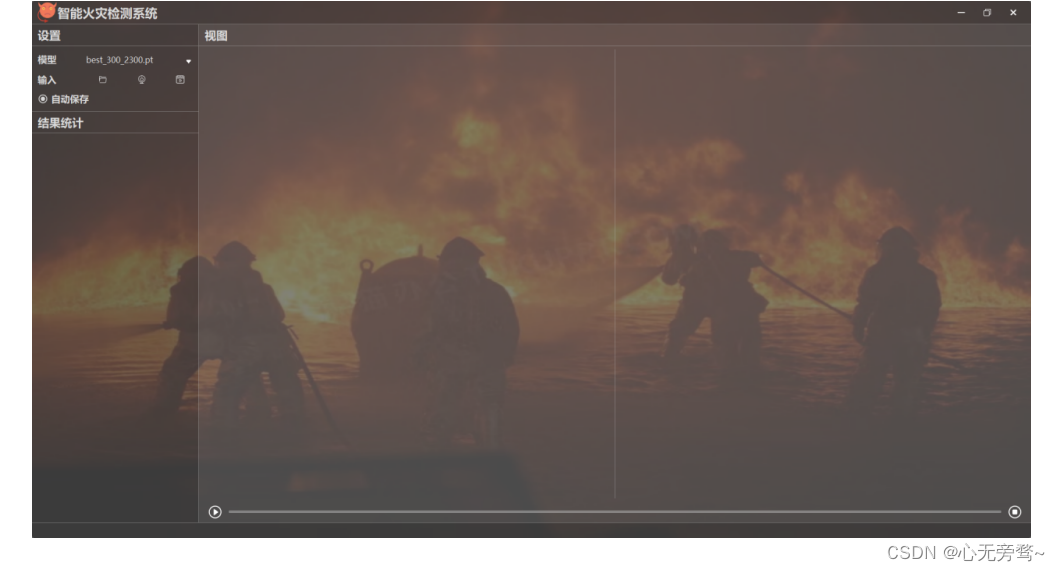

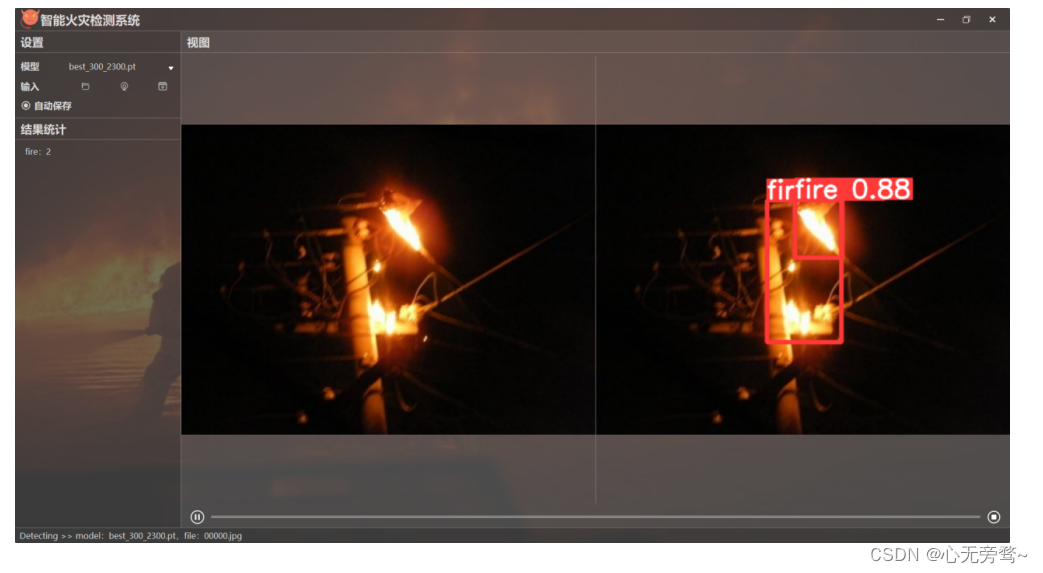

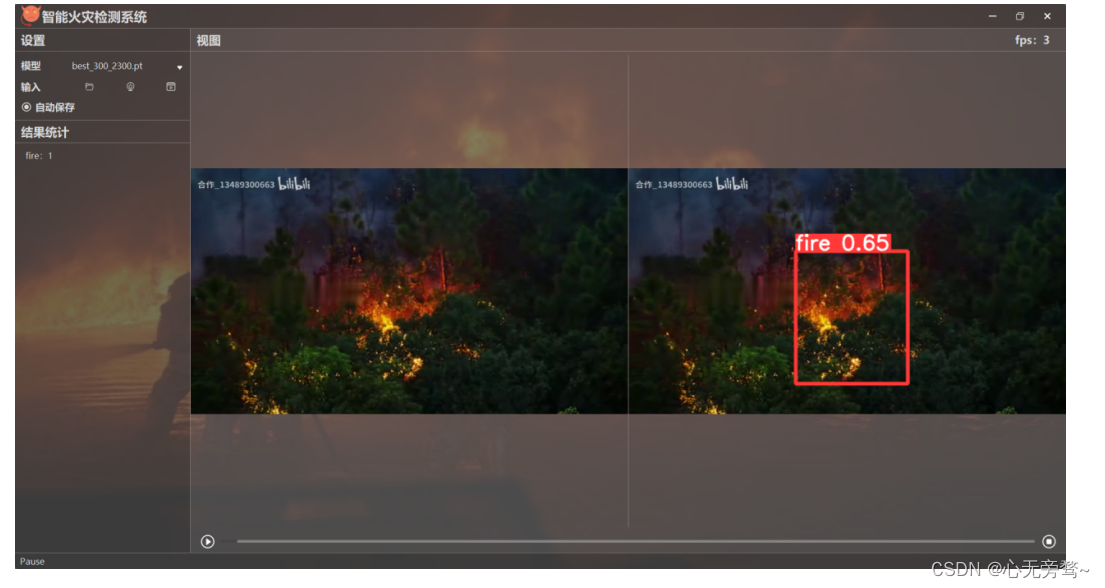

第二版软件界面

单张图片预测结果

视频流检测结果:

除此之外还可以进行摄像头检测,这里就不再过多演示。

一、实现思路

① 算法原理

YOLO(You Only Look Once) 是REDMON等提出的目标检测算法,作为单阶段(one-stage)的代表算法,目前 YOLO已经更新到了YOLOv5。相比于Two stage目标检测算法,YOLO是直接从网络中提取特征,并预测物体的类别和具体位置,一步到位。

此后,REDMON在此基础上提出了YOLO9000等检测算法,使系统的检测性能得到进一步提升。在YOLOv3的基础上继续改进升级,并最终得到 YOLOv4。YOLOv4网络结构主要由CSPDarknet53特征提取网、SPP(空间金字塔池化)模块、PANet特征融合模块、Yolo Head分类器组成。

YOLOv5算法使用CSPDarknet(跨阶段局部网络)作为特征提取网络,从输入图像中提取目标信息。如今,YOLOv5无论是在准确率还是速度上,都已经达到较好的效果。所以,本项目采用YOLOv5训练模型,结合YOLOv5算法构建火灾检测系统。

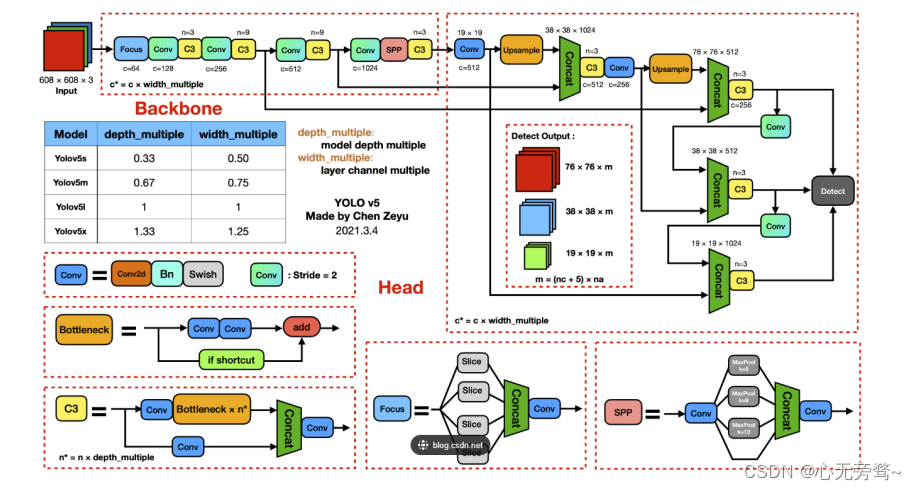

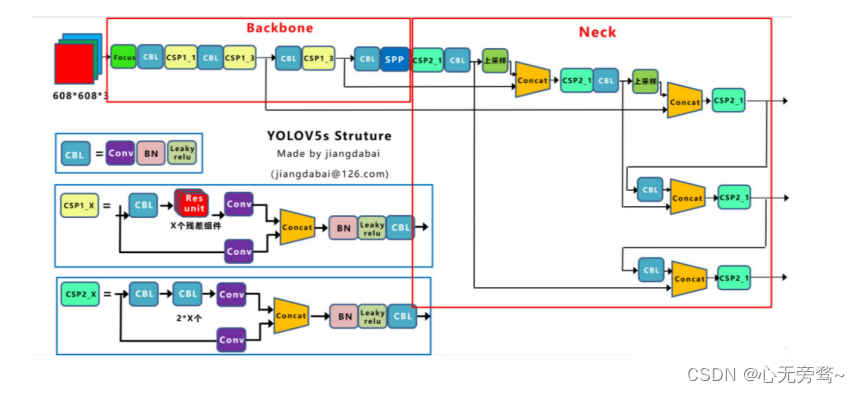

yolov5s的网络结构,它是yolov5系列中深度最小、特征图宽度最小的网络。后面的m、l、x都是在此基础上不断加深、加宽的。网络主要分为输入端、Backbone、Neck、Prediction四个部分。它和yolov3主要不同的地方:

- 输入端:Mosaic数据增强、自适应锚框计算、自适应图片缩放

- Backbone:Focus结构、CSP结构

- Neck:FPN+PAN结构

- Prediction:GIOU_Loss

YOLOv5 模型在输入端(Input)增加了 Mosaic 数据增强、自适应锚框计算、自适应图片缩放等数据预处理技巧来增强数据,防止过拟合;在特征提取网络部分(Backbone)引入了Focus 模块、跨阶段局部融合网络(CrossStage Partial Network, CSPNet)等方法,在减少了计算量的同时可以保证准确率,使特征能够更好的向后传递。下图为cspnet 结构图:

CSPNet主要目的就是缓解以前需要大量推理计算的问题,它有以下优点:

- 增强了CNN的学习能力,能够在轻量化的同时保持准确性。

- 降低计算瓶颈。

- 降低内存成本。

CSPNet通过将梯度的变化从头到尾地集成到特征图中,在减少了计算量的同时可以保证准确率。

CSPNet和PRN都是一个思想,将feature map拆成两个部分,一部分进行卷积操作,另一部分和上一部分卷积操作的结果进行concate。在特征融合部分(Neck)借鉴了空间金字塔池化(Spatial Pyramid Pooling, SPP)、特征金字塔(Feature Pyramid Networks, FPN)与路径聚合网络(PathAggregation Network, PAN)等方法,有效的增加主干特征的接收范围,融合后的特征保留了丰富的语义特征和精准的定位特征;同时在预测部分(Prediction)采用了新的定位损失函数,确保定位的精准。通过引入各种高效的网络组件,使得YOLOv5 模型在保持实时目标检测速度的基础上,也实现了精度上SOTA。

Input 使用了 Mosaic 数据增强、自适应锚框计算、图片尺寸处理。Mosaic 数据增强把 4 张图片,采用随机缩放、随机裁剪、随机排布的方式进行拼接 , 极大地丰富了检测数据集,同时也能提高小目标检测的精度,除此以外,Mosaic数据增强在训练时可一次性对 4 张图片的数据进行计算,降低了 mini-batch 的大小,也减少了 GPU 的使用。YOLOv5 将自适应锚框计算嵌入代码中,通过在初始设定的锚框上输出预测框,然后和真实标签进行比对,计算损失函数,再不断更新,更新锚点框的大小,实现自适应计算并得出最佳锚框值。图片尺寸处理是对输入的各种图片的尺寸进行自适应填充处理,为了提高目标检测的速度,采用了减少灰度边缘的方法。

Backbone 是 YOLOv5 网络的主干部分,包含 Focus 结构、CSP 结构和 SPP 结构。其 中 Focus 结 构: 主 要 进 行 切 片 操 作, 只 存 在 于YOLOv5 算法中,以 YOLOv5s 为例,将原始三通道图像输入 Focus 结构,经过切片操作后,进行拼接,图片尺寸缩小到原来的 1/4、输入通道扩充到原来的 4 倍,经过 32 个卷积核的卷积计算,最终得到含有 32 个通道的特征图。YOLOv5s、YOLOv5m、YOLOv5x 和 YOLOv5l, 使 用 的 卷积核数量依次增加,其中,YOLOv5m 使用了 48 个卷积核。卷积核个数越多 , 特征图的宽度越宽 , 网络提取特征的学习能力也越强。开发者认为,Focus 模块的设计目的是减少层数并降低计算量。

- CSP 结构:YOLOv5 中设计了 CSP1_N 和 CSP2_N 两种CSP 结构,CSP1_N 应用于 Backbone 作为主干网络,CSP2_N 应用在 Neck 中,这部分没有残差组件。CSP1_N 结构将基础层的特征映射划分为两个不同的部分,其中之一就是将 N个残差组件进行卷积操作,另一部分则是直接进行卷积操作,两次卷积操作可以使通道数减半,然后通过拼接来进行输出。

- SPP 结构:在 Backbone 中,采用 SPP(空间向量金字塔池化)。多尺度融合是通过最大化池来实现的。

Neck 采用 FPN+PAN 的结构。FPN 结构是自上向下传递强特征,对结构起到增强的作用,然而,FPN 只能增强语义信息,而不能传递位置信息。而 PAN 结构刚好弥补了 FPN结构不能进行定位信息传递的缺陷,PAN 结构自下向上将低层的强定位特征传递上去,两者结合操作,增强网络特征融合的能力。

最后,本次 Yolov5 采用 GIOU_Loss 作 Bounding box 的损失函数GIOU_Loss 能够区分重叠的预测框和目标框在 IOU 相同时两者相交情况的不同。另外,针对预测过程中会出现多个预测框的情况,需要通过非极大值抑制即 NMS 来处理,Yolov5 使用加权 NMS 来筛选最佳的预测框。

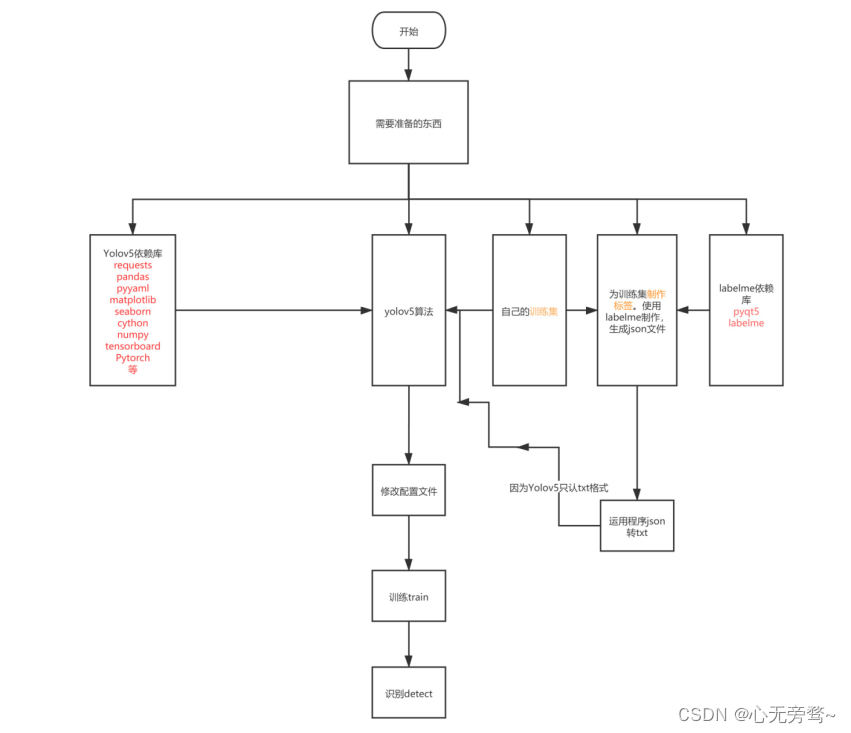

② 程序流程图

这里借用网上的一张流程图,具体实现流程如下:

二、系统设计与实现

系统设计

系统设计主要使用PyQt5进行前端UI界面的搭建,同时使用PyTorch框架进行YOLOv5算法的训练以及部署。

具体设计采用基于YOLOv5的算法进行火灾检测,并结合PyQt5进行UI界面的制作。系统通过摄像头实时采集森林图像,利用训练好的YOLOv5模型对图像进行火灾检测。检测到火灾后,系统将及时发出警报,并在UI界面上显示火灾发生的位置和相关信息。为了确保系统的稳定性和实时性,我采用了高性能的服务器和存储设备,并优化了模型的检测精度和性能。UI界面设计考虑了用户的易用性和交互体验,采用直观的布局和功能设置,使用户能够通过简单的操作完成火灾监测任务。未来,我将继续改进和优化系统,提高火灾检测的准确性和效率,并探索更多的应用场景和功能扩展。

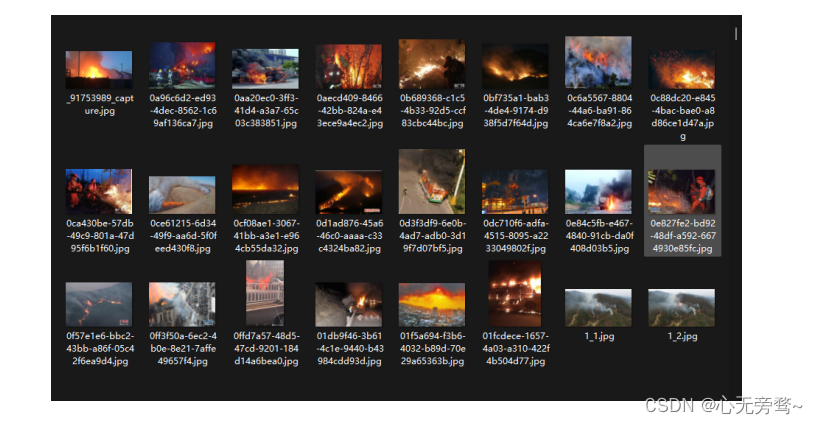

数据集获取

数据集是在网上进行的获取,总共随机选出训练集 1442 张,测试集共617 张,验证集共 617 张。

三、模型评估与优化

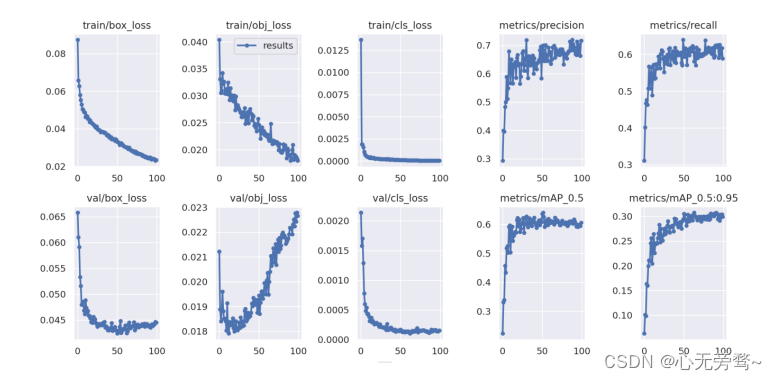

Yolov5的m模型训练结果:

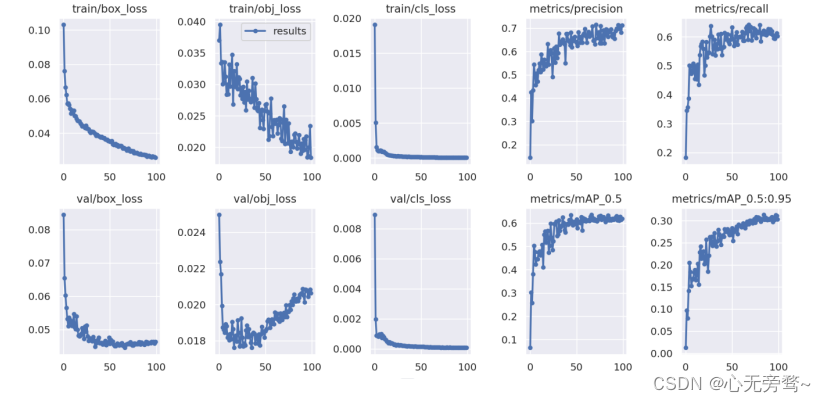

Yolov5的s模型训练结果:

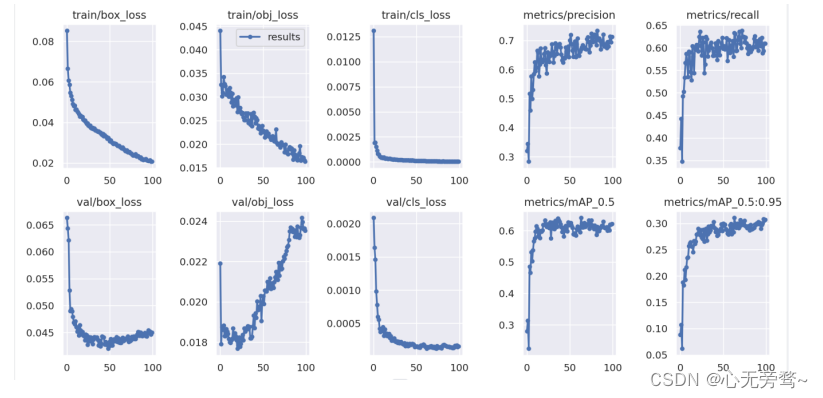

Yolov5的l模型训练结果:

模型优化

在基于YOLOv5的火灾监测系统项目中,为了提高模型的性能,我对超参数和数据增强进行了深入的优化。以下是对这两方面优化的详细总结。

首先是超参数优化部分,对于超参数优化,主要工作如下:

1.学习率调整:为了确保模型在训练过程中既能快速收敛,又不至于在最优解附近震荡,我使用了学习率衰减策略,例如StepLR和CosineAnnealingLR。通过不断调整衰减的步长和因子,找到了一个较为合适的学习率调整策略。

2.批次大小选择:批次大小的选择影响了模型的训练速度和梯度更新的稳定性。经过实验,我发现较小的批次大小(如8或16)配合适当的学习率可以获得更好的收敛效果。

3.权重衰减:为了防止模型过拟合,我引入了权重衰减正则化。通过调整衰减系数,可以在一定程度上减少模型复杂度,提高泛化能力。

4.优化器选择:我对比了Adam和SGD两种优化器,发现在火灾监测任务中,SGD配合适当的动量和学习率调整策略可以获得更好的性能。

5.激活函数调整:考虑到ReLU可能在某些情况下导致神经元“死亡”,我尝试了其变种,如LeakyReLU和Mish,最终发现Mish在YOLOv5中的表现略胜一筹。

其次是数据增强方面的优化:

1.基础增强:使用了随机水平翻转、随机裁剪和颜色抖动等基础增强方法,这可以增加模型对目标位置和颜色的鲁棒性。

2.Mosaic数据增强:使用YOLO系列的Mosaic方法,将四张训练图片混合成一张,增强了模型对复杂背景和多个目标的处理能力。

3.自适应缩放:为了使模型更好地适应不同尺度的目标,我对训练图片进行了随机缩放,确保模型能在不同分辨率下工作。

4.旋转与扭曲:考虑到火灾场景中目标可能出现的各种角度,我引入了随机旋转和透视变换,这有助于模型更好地捕捉目标的形状变化。

5.背景替换:为了减少模型对固定背景的依赖,我使用了背景替换技术,随机替换训练图片中的背景区域,从而提高模型对背景的泛化能力。

HSV颜色空间变换:在HSV颜色空间进行随机色调、饱和度和亮度变换,帮助模型更好地适应不同光照和颜色条件下的目标。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 通过全网热议的“通义舞王”,你对AI有什么奇思妙想?

- 初识 WebGPU 以及遇到 WebGPU not supported 错误的解决方法

- QT+jenkins window环境实现一键自动化构建打包签名发布

- Mermaid 教程

- 图像融合论文阅读:CoCoNet: 基于多层特征集成的耦合对比学习网络多模态图像融合

- MySQL数据库下载及安装教程(最最新版)

- 单片机与直流电机PWM级调速控制

- Unity Window安装包制作

- 遥感图像之多模态检索AMFMN(支持关键词、句子对图像的检索)论文阅读、环境搭建、模型测试、模型训练

- pgsql的jsonb相关处理及样例