实验笔记之——Linux实现COLMAP

之前博客跑instant-NGP的时候,除了用官方的数据集,用自己的数据则是通过手机采集,同时获得pose与image。但是这种获取的方式对于3D gaussian而言,并不支持对应的数据格式,为此采用COLMAP来根据image获取pose,进而给NeRF提供数据~

实验笔记之——基于windows复现Instant-NGP-CSDN博客文章浏览阅读726次,点赞19次,收藏10次。之前博客对NeRF-SLAM进行了调研,本博文先复现一下Intant-NGP。学习笔记之——NeRF SLAM(基于神经辐射场的SLAM)-CSDN博客NeRF 所做的任务是 Novel View Synthesis(新视角合成),即在若干已知视角下对场景进行一系列的观测(相机内外参、图像、Pose 等),合成任意新视角下的图像。传统方法中,通常这一任务采用三维重建再渲染的方式实现,NeRF 希望不进行显式的三维重建过程,仅根据内外参直接得到新视角渲染的图像。https://blog.csdn.net/gwplovekimi/article/details/135336357?spm=1001.2014.3001.5502配置的过程请参考官网链接:Installation — COLMAP 3.9-dev documentation

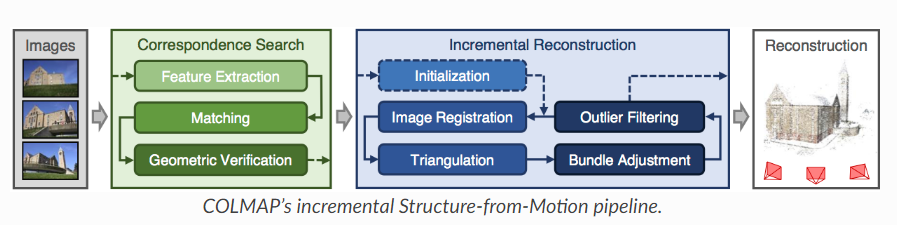

COLMAP实际上就是sfm了~原理就不细看了,直接用了

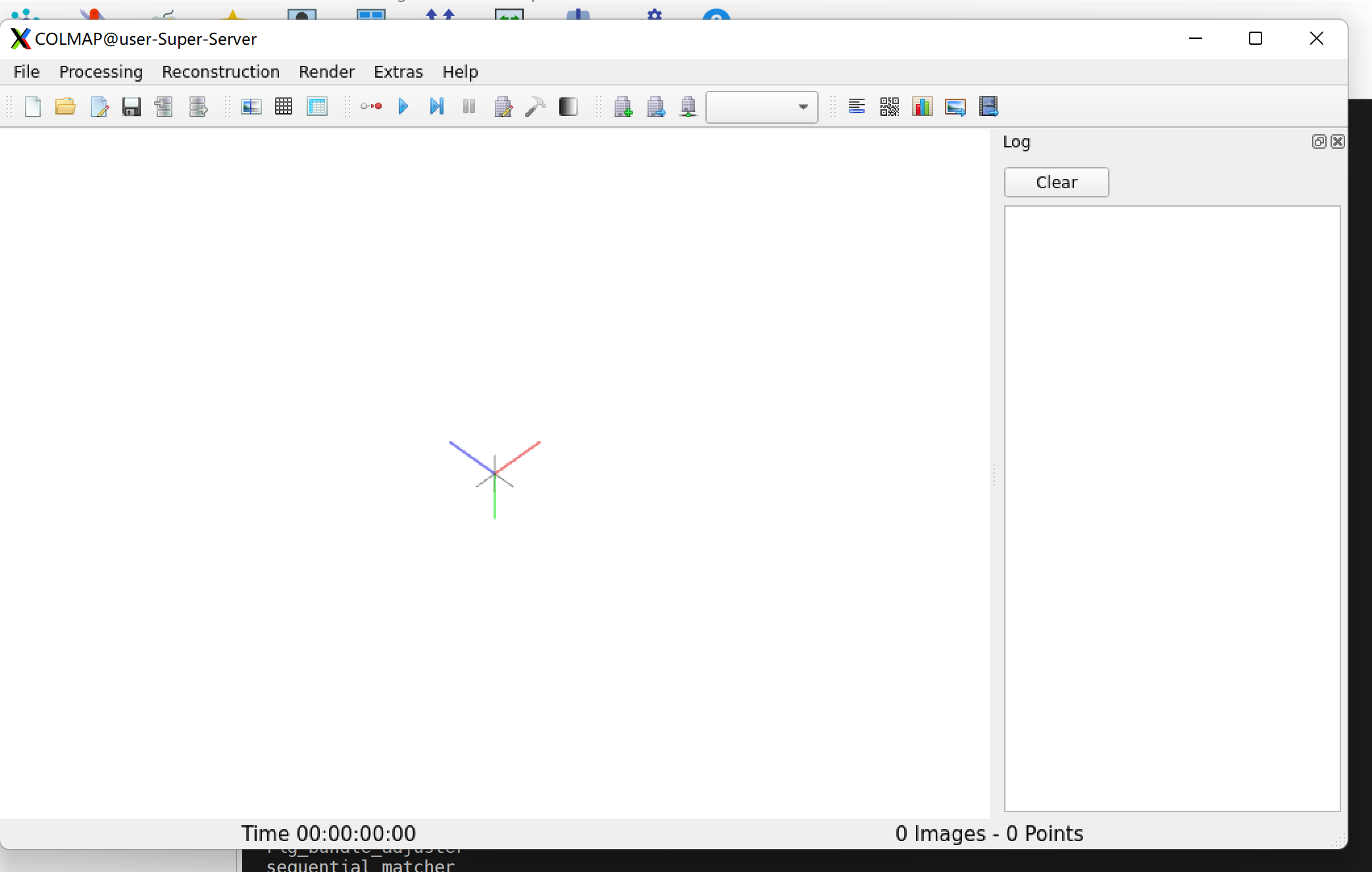

由于实验室的服务器已经安装好了COLMAP了,所以此处就直接使用。通过下面命令即可开启COLMAP的GUI

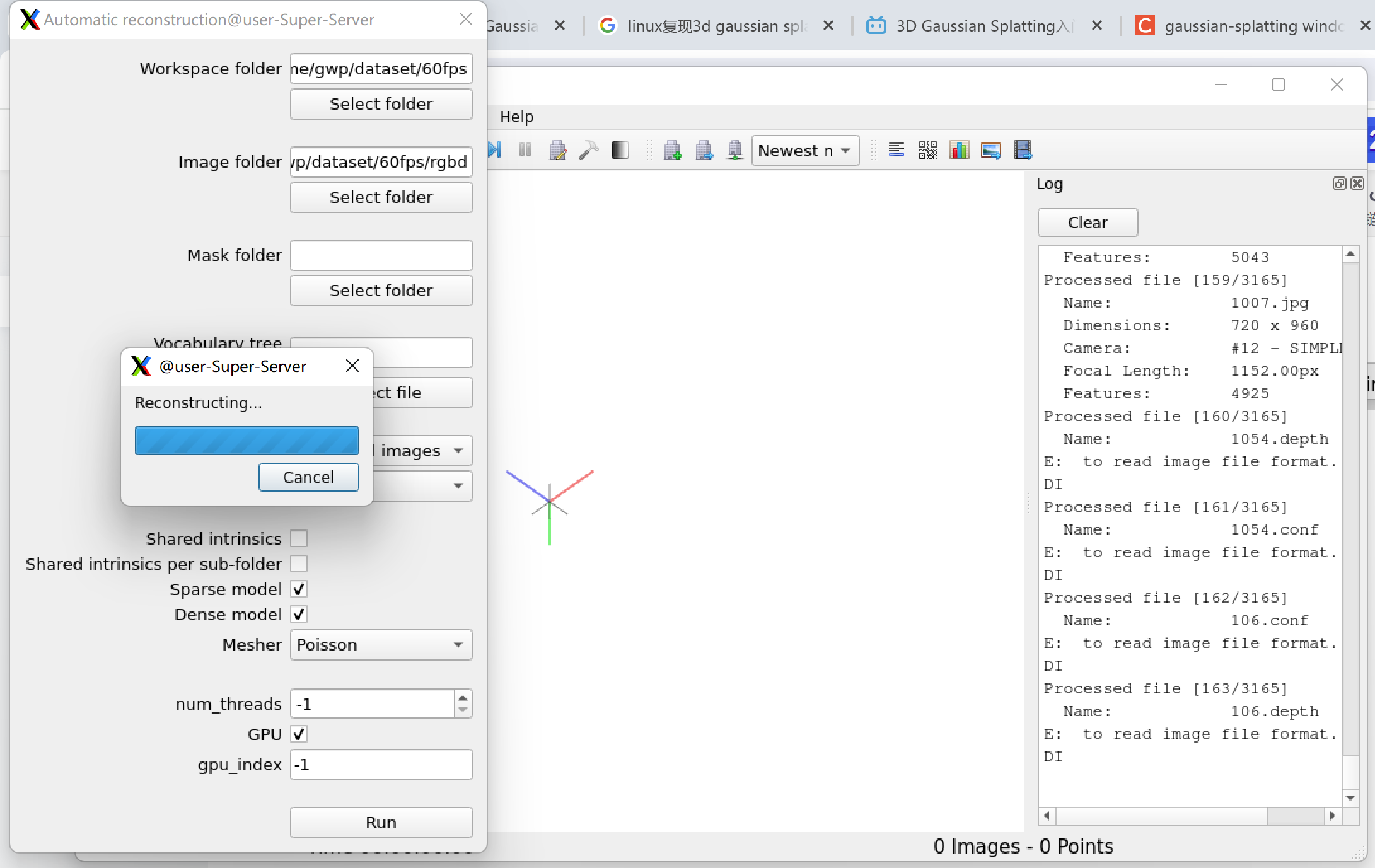

colmap gui如下所示

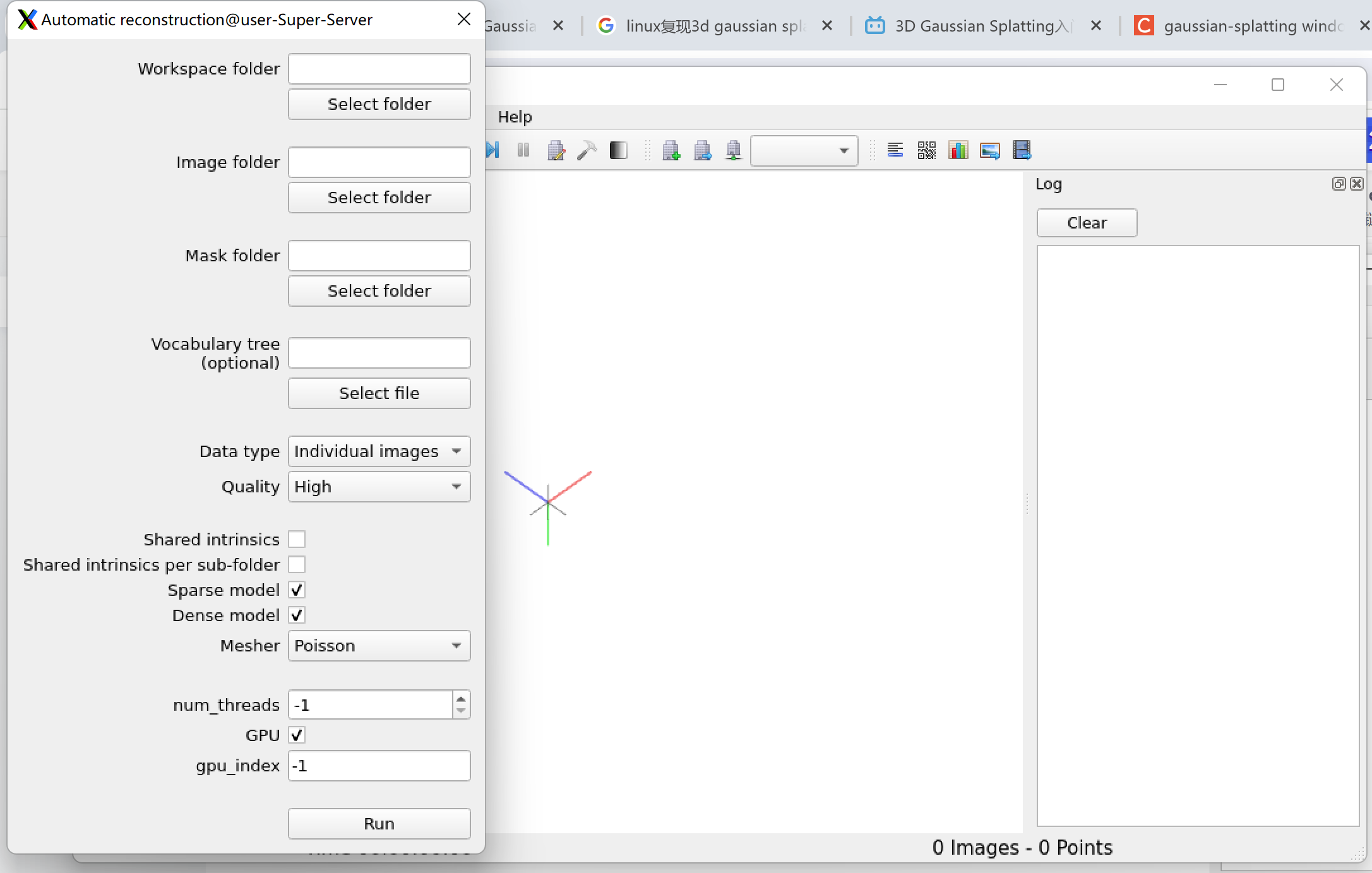

点击Reconstruction?>?Automatic?Reconstruction进行一系列基本设置

输出的结果会写在workspace folder中(如果图像在path/to/project/images中,那么就应该选择path/to/project作为workspace)

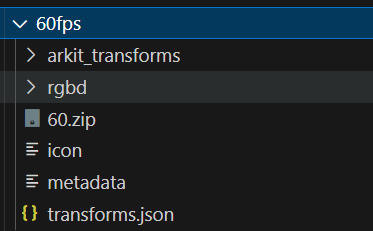

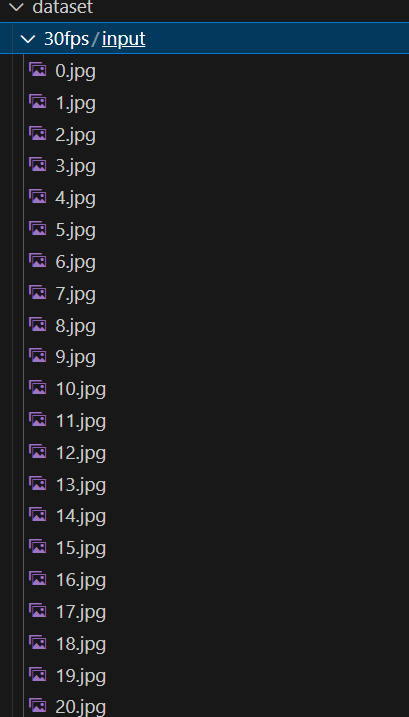

而由于我当前的数据结构如下,所以也要设置一下image folder

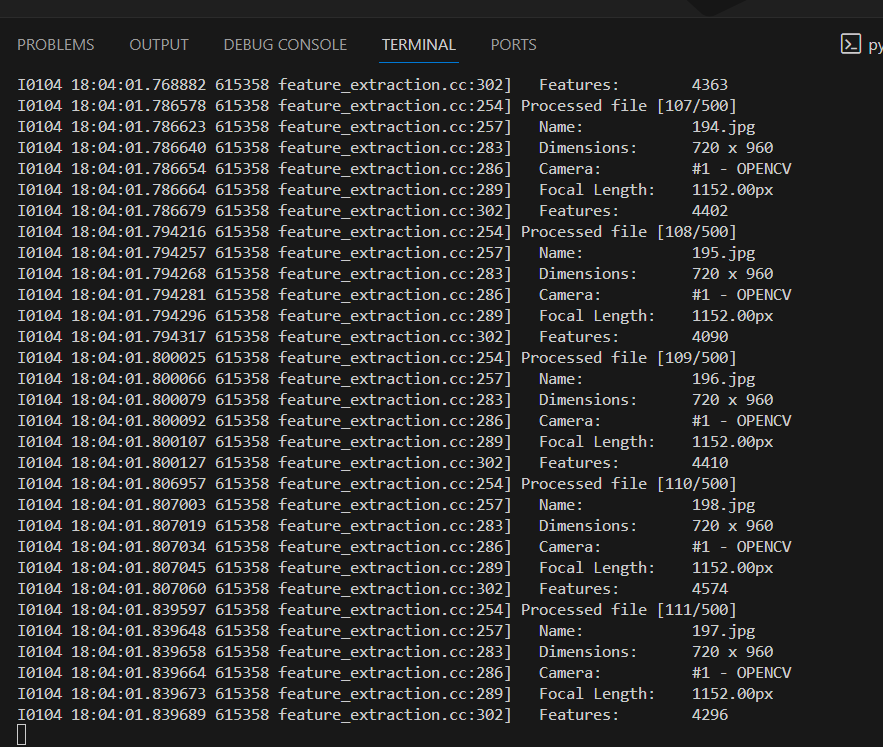

然后点击run

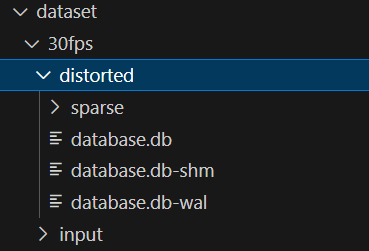

在运行automatic reconstration之后,文件夹会变成这样

+── images

│ +── image1.jpg

│ +── image2.jpg

│ +── ...

+── sparse

│ +── 0

│ │ +── cameras.bin

│ │ +── images.bin

│ │ +── points3D.bin

│ +── ...

+── dense

│ +── 0

│ │ +── images

│ │ +── sparse

│ │ +── stereo

│ │ +── fused.ply

│ │ +── meshed-poisson.ply

│ │ +── meshed-delaunay.ply

│ +── ...

+── database.db然后,?path/to/project/sparse包含的是重建得到的稀疏模型,?path/to/project/dense包含的是dense模型, 点云fused.ply可以加载到COLMAP图形界面中, 从File>Importmodelfrom...进入,而密集的网格必须通过外部查看器(如Meshlab)来可视化。

而在3D Gaussian中,写好了脚本去跑的(忽略ImageMagick ,因为手机产生的图片失真应该比较少)

此处直接用

python convert.py -s <location> [--resize] #If not resizing, ImageMagick is not needed需要将图片打包好如下格式

<location>

|---input

|---<image 0>

|---<image 1>

|---...

运行

python convert.py -s /home/gwp/dataset/30fps

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Android课程设计,安卓期末大作业,毕业设计,100..多个项目源代码+实验报告+数据库

- Python接口自动化测试项目实战

- BaiJiaCms 漏洞挖掘

- 2024年工信部颁发的AI人工智能证书

- 计算机毕业设计-----ssm流浪狗领养系统

- 九州金榜|15岁初三男孩抑郁休学摆烂打游戏,高压教育要不得!

- 2023全新返佣商城分销商城理财商城系统源码 全开源PHP+VUE源码

- 最新ChatGPT网站系统源码+详细搭建部署教程+Midjourney绘画AI绘画

- Java构建线程的方式

- ERP系统软件哪家好?盘点国内外十大erp系统软件