联合熵与条件熵:信息论中的重要概念探析

在信息论中,联合熵和条件熵是重要的概念,用于描述随机变量的不确定性和信息量。本文将以联合熵和条件熵为主题,从定义、计算方法、应用领域等方面进行探析,帮助读者更好地理解和运用这些概念。

第一部分:联合熵的定义与计算方法

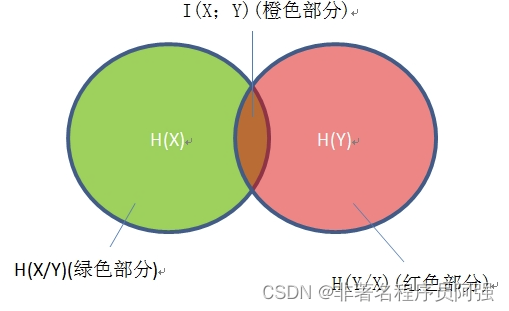

联合熵是指多个随机变量的联合分布的不确定性度量。它表示了在给定所有变量的情况下,所需的平均信息量。联合熵的计算方法可以通过对联合概率分布进行求和和取负数来获得,具体计算公式为:H(X, Y) = -ΣΣP(X, Y)logP(X, Y),其中P(X, Y)表示随机变量X和Y的联合概率分布。

第二部分:条件熵的定义与计算方法

条件熵是在给定某个条件下,随机变量的不确定性度量。它表示了在已知一部分信息时,还需获得的平均信息量。条件熵的计算方法可以通过对条件概率分布进行求和和取负数来获得,具体计算公式为:

H(X|Y) = -ΣΣP(X, Y)logP(X|Y)

其中P(X|Y)表示在给定Y的条件下,随机变量X的条件概率分布。

第三部分:联合熵与条件熵的关系与应用

联合熵和条件熵之间存在着密切的联系。通过联合熵和条件熵的差值,我们可以得到互信息。互信息表示了两个随机变量之间的相互依赖程度和信息传递量。具体计算公式为:

I(X; Y) = H(X) - H(X|Y) = H(Y) - H(Y|X)

互信息可以用于特征选择、数据压缩、图像处理、自然语言处理等领域。

在信息论中,联合熵和条件熵有着广泛的应用。在数据压缩领域,联合熵可以帮助我们评估数据的冗余性和压缩效果,通过降低冗余来实现数据的高效存储和传输。在机器学习领域,条件熵可以用于评估模型的复杂度和信息增益,帮助我们进行特征选择和模型优化,提高模型的预测能力。此外,在通信系统设计和信息传输方面,联合熵和条件熵也有着重要的应用,可以帮助我们设计高效的通信协议和优化信道编码方案。

联合熵和条件熵在信息论中是重要的概念,用于度量随机变量的不确定性和信息量。通过联合熵和条件熵的计算,我们可以获得互信息,通过互信息的分析,我们可以评估随机变量之间的相互依赖程度和信息传递量。联合熵和条件熵在数据压缩、机器学习、通信系统设计等领域有着广泛的应用。深入理解和应用这些概念,有助于我们更好地处理和利用信息。

【学习交流群】不知道怎么学?遇到问题没人问?到处找资料?邀请你加入我的人工智能学习交流群,群内气氛活跃,大咖小白、在职、学生都有,还有群友整理收集的100G教程资料,点击下方进群占位。(点击跳转到群二维码,请放心点击!)扫码进群领资料

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 2D和3D视觉技术有哪些不同特点?

- 手把手教你用jmeter做压力测试(详图)

- 移动端开发框架mui代码在安卓模拟器上运行2(HbuilderX连接到模拟器)模拟器窗口及多开设置

- 鸿蒙应用开发 新闻数据加载

- 漫谈大模型的[幻觉]问题

- golang编译失败:import cycle not allowed

- jQuery实现鼠标移入高亮

- Element中的el-table中如何获取每一行的id

- 面向对象程序设计(并发)

- 还没有自己的博客系统么 使用Docker Compose快速部署Typecho博客系统