可能是全网最详细的线性回归原理讲解!!!

发布时间:2023年12月18日

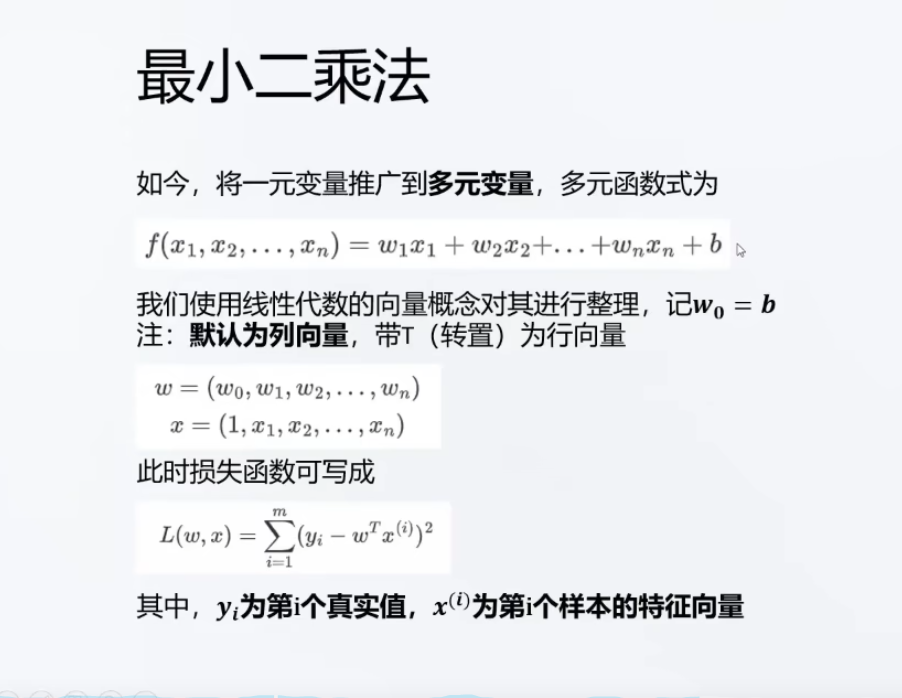

ps:此处的特征向量有别于线性代数中的特征向量,准确来讲这里的特征向量是一个样本的所有属性值。

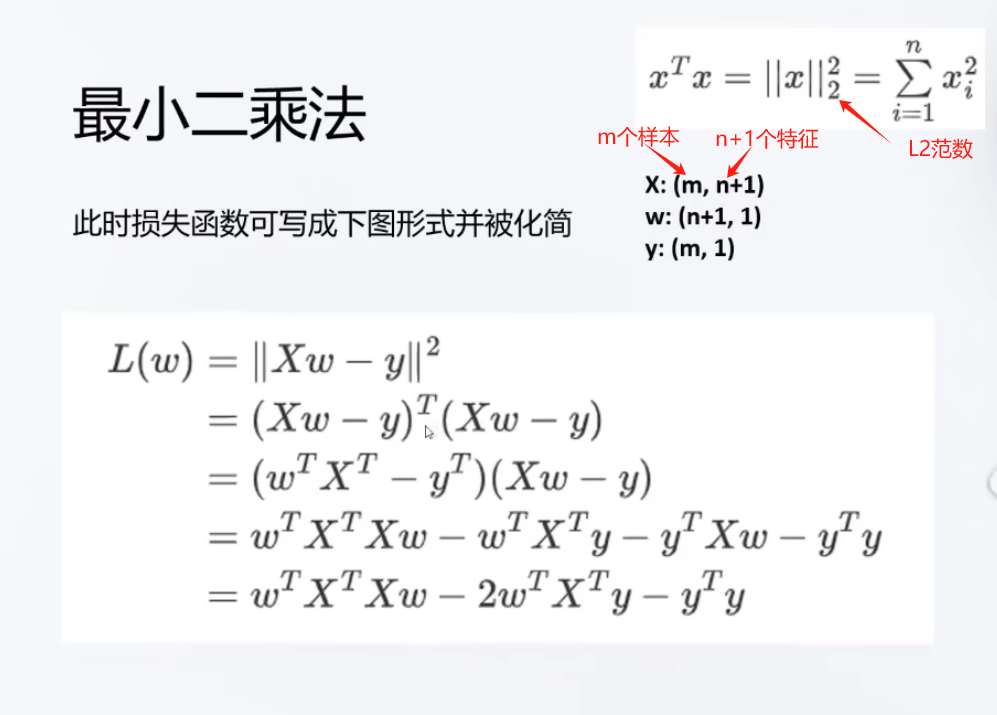

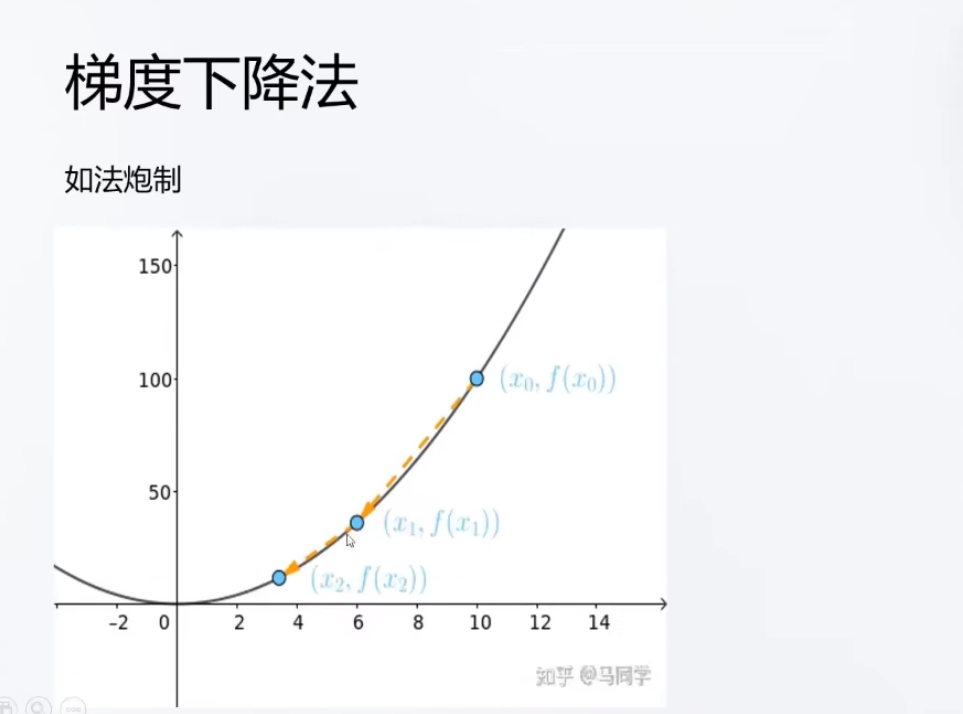

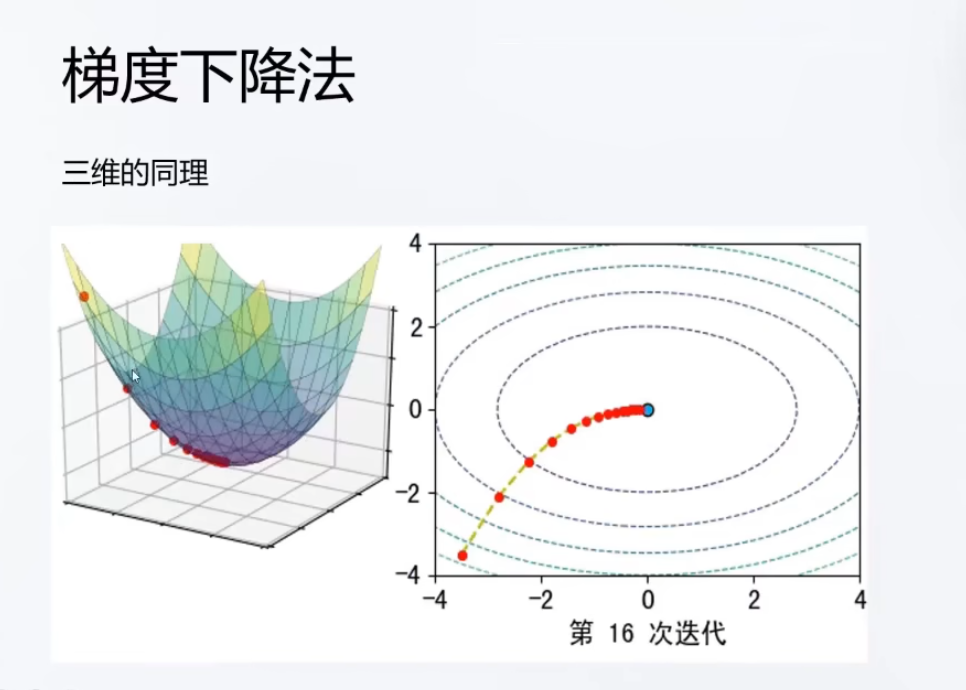

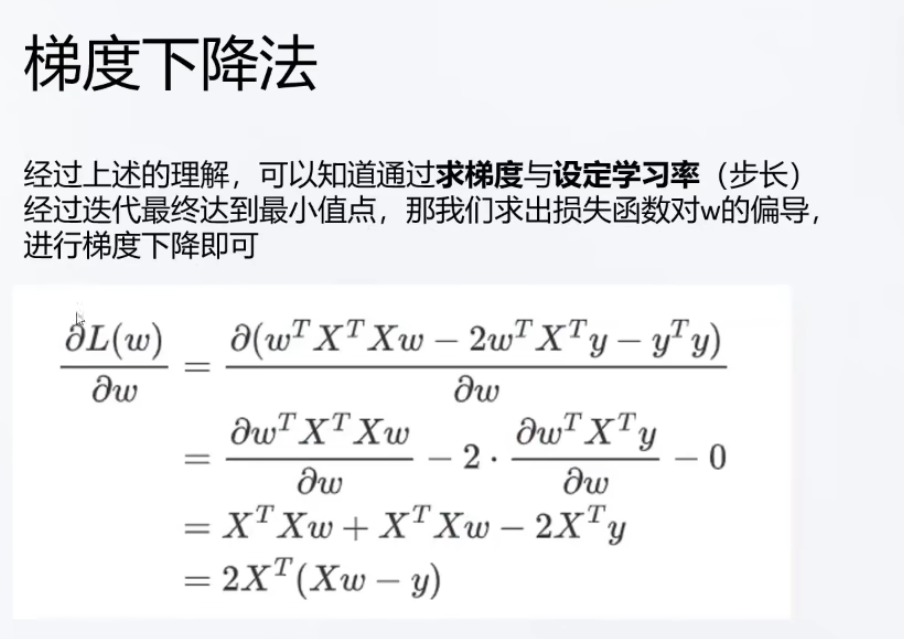

用梯度下降慢慢逼近这个最小值点

本文图片来源于可能是全网最详细的线性回归原理讲解!!!_哔哩哔哩_bilibili

本文图片来源于可能是全网最详细的线性回归原理讲解!!!_哔哩哔哩_bilibili

可以结合视频来学习,本文是一个图片教程,有错误欢迎大家指正,多多交流!

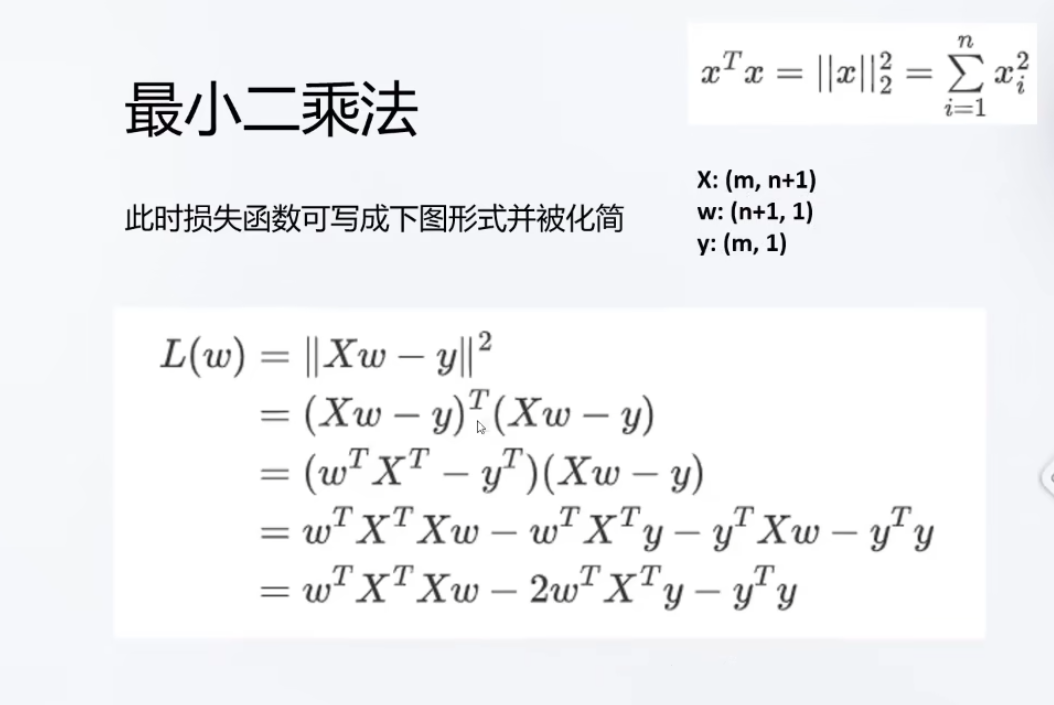

所用到的两个矩阵求导公式参考于知乎:https://zhuanlan.zhihu.com/p/273729929,里面有公式的详细证明 梯度下降法参考于知乎 马同学:https://www.zhihu.com/question/305638940/answer/1639782992,个人觉得是讲梯度下降中最直观的一个回答

文章来源:https://blog.csdn.net/daima3/article/details/135070990

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- js遍历后端返回的集合将条件相同的放入同一个数组内

- 抖店可以直接开播吗?说下抖店的具体出单玩法和流程,内容可收藏

- 设计模式之-组合模式,快速掌握组合模式,通俗易懂的讲解组合模式以及它的使用场景

- 安科瑞Acrel-3000WEB电能管理解决方案在提高供电企业的管理效率和供电效益上的应用

- java基础语法01

- 设计模式-享元模式

- [论文阅读]Self-Supervised Learning for Videos: A Survey

- 回归模型代码实现

- nginx rewrite重写URL地址, laravel路由404问题

- OSPF-(LSA+SPF)