分类预测 | Matlab实现RP-CNN-LSTM-Attention递归图优化卷积长短期记忆神经网络注意力机制的数据分类预测【24年新算法】

发布时间:2024年01月04日

分类预测 | Matlab实现RP-CNN-LSTM-Attention递归图优化卷积长短期记忆神经网络注意力机制的数据分类预测【24年新算法】

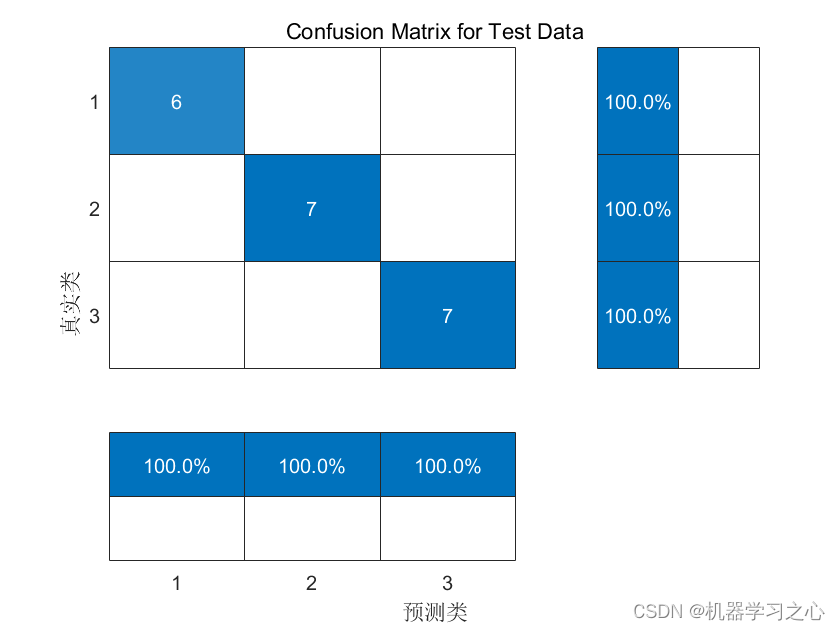

分类效果

基本描述

1.Matlab实现RP-CNN-LSTM-Attention递归图优化卷积长短期记忆神经网络注意力机制的数据分类预测【24年新算法】(完整源码和数据)

2.自带数据,多输入,单输出,多分类。图很多,包括迭代曲线图、混淆矩阵图、预测效果图等等。

3.直接替换数据即可使用,保证程序可正常运行。运行环境MATLAB2023及以上。

4.代码特点:参数化编程、参数可方便更改、代码编程思路清晰、注释明细。

模型描述

递归图(recurrence plot, RP)是分析时间序列周期性、混沌性以及非平稳性的一个重要方法,可以揭示时间序列的内部结构,给出有关相似性、信息量和预测性的先验知识。递归图特别适合短时间序列数据,可以检验时间序列的平稳性、内在相似性。

RP-CNN-LSTM-Attention是一种递归图优化的卷积长短期记忆神经网络(CNN-LSTM),同时结合了注意力机制,用于数据分类预测。这种模型在处理序列数据时能够更好地捕捉时序信息和重要特征,并提高分类性能。

程序设计

- 完整程序和数据私信博主回复Matlab实现RP-CNN-LSTM-Attention递归图优化卷积长短期记忆神经网络注意力机制的数据分类预测【24年新算法】。

%% 参数设置

%% 建立模型

lgraph = addLayers(lgraph, tempLayers); % 将上述网络结构加入空白结构中

tempLayers = [

sequenceUnfoldingLayer("Name", "sequnfold") % 建立序列反折叠层

flattenLayer("Name", "flatten") % 网络铺平层

lstmLayer(best_hd, "Name", "lstm", "OutputMode","last")

fullyConnectedLayer(num_class, "Name", "fc") % 全连接层

softmaxLayer("Name", "softmax") % softmax激活层

classificationLayer("Name", "classification")]; % 分类层

lgraph = addLayers(lgraph, tempLayers); % 将上述网络结构加入空白结构中

lgraph = connectLayers(lgraph, "seqfold/out", "conv_1"); % 折叠层输出 连接 卷积层输入

lgraph = connectLayers(lgraph, "seqfold/miniBatchSize", "sequnfold/miniBatchSize");

% 折叠层输出连接反折叠层输入

lgraph = connectLayers(lgraph, "relu_2", "sequnfold/in"); % 激活层输出 连接 反折叠层输入

%% 参数设置

options = trainingOptions('adam', ... % Adam 梯度下降算法

'MaxEpochs', 500,... % 最大训练次数

'InitialLearnRate', best_lr,... % 初始学习率为0.001

'L2Regularization', best_l2,... % L2正则化参数

'LearnRateSchedule', 'piecewise',... % 学习率下降

'LearnRateDropFactor', 0.1,... % 学习率下降因子 0.1

'LearnRateDropPeriod', 400,... % 经过训练后 学习率为 0.001*0.1

'Shuffle', 'every-epoch',... % 每次训练打乱数据集

'ValidationPatience', Inf,... % 关闭验证

'Plots', 'training-progress',... % 画出曲线

'Verbose', false);

%% 训练

net = trainNetwork(p_train, t_train, lgraph, options);

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/129036772?spm=1001.2014.3001.5502

[2] https://blog.csdn.net/kjm13182345320/article/details/128690229

文章来源:https://blog.csdn.net/kjm13182345320/article/details/135385630

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- Codeforces Round 855 (Div. 3) A-E题解

- git(安装,常用命令,分支操作,gitee,IDEA集成git,IDEA集成gitee,IDEA集成github,远程仓库操作)

- 克服传统企业数字化转型的十大阻力

- 外汇天眼:每一个骗局的背后,可能是倾家荡产!

- 【操作系统】第五章 存储器与虚拟存储器

- 零基础编译 OpenWrt:打造定制化嵌入式 Linux 系统

- 【数据结构入门精讲 | 第八篇】一文讲清全部排序算法(2)

- 鸿蒙OS应用开发之索引列表选择

- Salesforce财务状况分析

- MySQL数据库 约束