基于matlab的LSTM模型

发布时间:2024年01月17日

1 介绍

使用matlab处理时序预测问题,导入的是一个一维向量,前5个作为输入,第6个作为输出,这样就是1-5输入,6输出,2-6输入,7输出。使用matlab进行处理,先进行数据形状改变,归一化等,然后搭建lstm模型,再进行预测,在使用的过程中,由于数据数量级差别过大,所以使用log对数据进行处理

2 导入数据,数据处理

%% 导入数据(时间序列的单列数据)

result = xlsread('data1.xlsx');

result = log(result);

%% 数据分析

num_samples = length(result); % 样本个数

kim = 5; % 延时步长(kim个历史数据作为自变量)

zim = 1; % 跨zim个时间点进行预测

%% 划分数据集

for i = 1: num_samples - kim - zim + 1

res(i, :) = [reshape(result(i: i + kim - 1), 1, kim), result(i + kim + zim - 1)];

end

%% 划分训练集和测试集

temp = 1: 1: 20475;

P_train = res(temp(1: 16379), 1: kim)';

T_train = res(temp(1: 16379), kim+1)';

M = size(P_train, 2);

P_test = res(temp(16380: end), 1: kim)';

T_test = res(temp(16380: end), kim+1)';

N = size(P_test, 2);

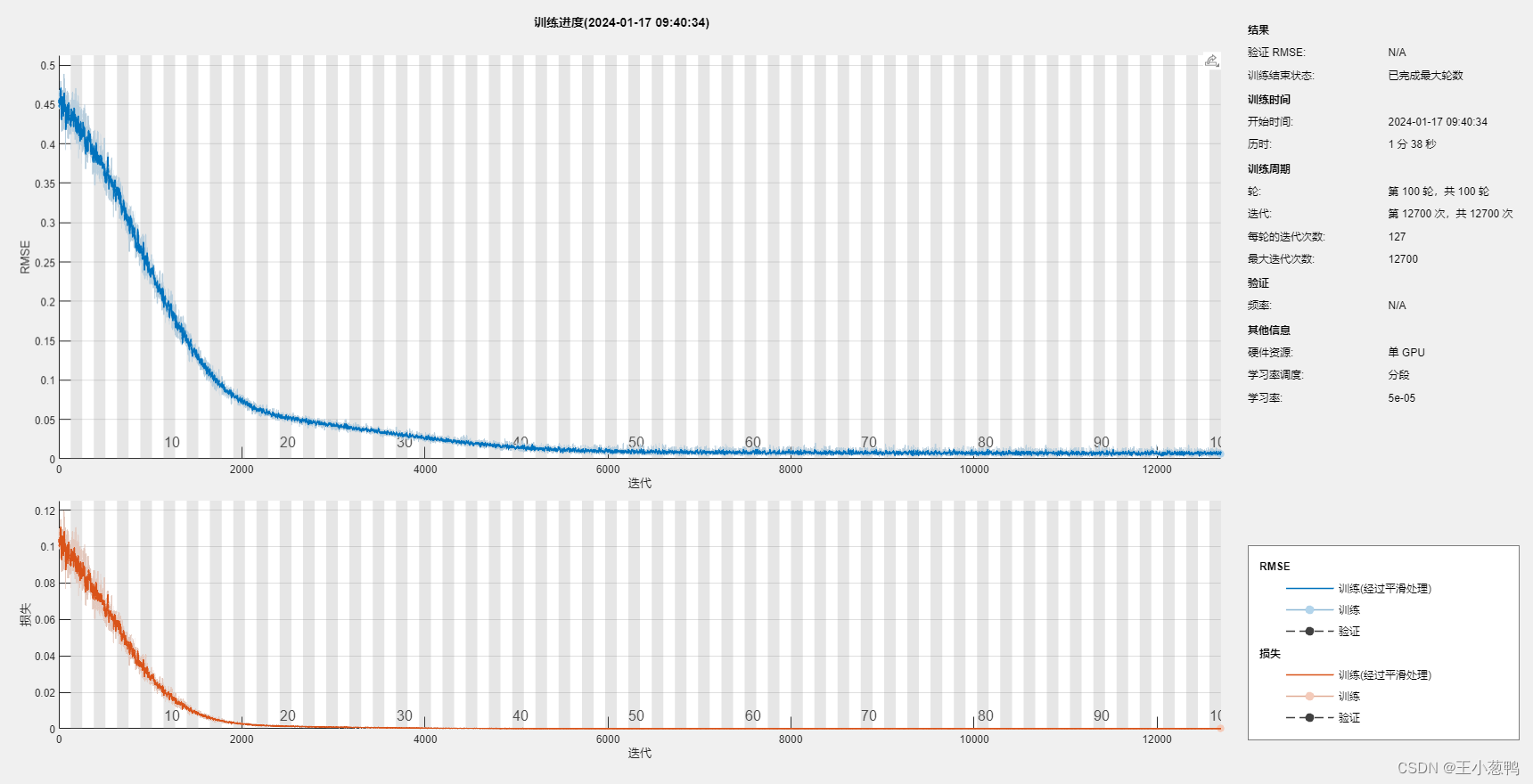

3 搭建模型和训练

%% 创建模型

layers = [

sequenceInputLayer(5) % 建立输入层

lstmLayer(10, 'OutputMode', 'last') % LSTM层

reluLayer % Relu激活层

fullyConnectedLayer(1) % 全连接层

regressionLayer]; % 回归层

%% 参数设置

options = trainingOptions('adam', ... % Adam 梯度下降算法

'MaxEpochs', 100, ... % 最大训练次数

'InitialLearnRate', 5e-5, ... % 初始学习率

'LearnRateSchedule', 'piecewise', ... % 学习率下降

'LearnRateDropFactor', 0.1, ... % 学习率下降因子

'LearnRateDropPeriod', 800, ... % 经过800次训练后 学习率为 0.005 * 0.1

'Shuffle', 'every-epoch', ... % 每次训练打乱数据集

'Plots', 'training-progress', ... % 画出曲线

'Verbose', false);

%% 训练模型

net = trainNetwork(p_train, t_train, layers, options); % 训练集输入、训练集输出、模型结构、超参数

4 最后的结果展示

如果有需要,可以联系:https://docs.qq.com/doc/DWEtRempVZ1NSZHdQ。

文章来源:https://blog.csdn.net/ww596520206/article/details/135643168

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 「会议推荐」食品饮料行业数字化、智能化转型升级高质量发展论坛

- Objectiv-C设计模式笔记

- 初探UAF漏洞(3)

- 单酿葡萄酒和混酿葡萄酒的区别

- 零拷贝原理详解

- [足式机器人]Part2 Dr. CAN学习笔记- Kalman Filter卡尔曼滤波器Ch05-3+4

- 第十一章 NodeJs express

- 工业相机+镜头选型及靶面、焦距计算等相关详解

- 历史日志·洪武朝武功一览

- BiLSTM(双向长短时记忆网络)和BiGRU(双向门控循环单元)的区别