EdgeSAM革新:iPhone上的实时SAM,速度提升40倍!

引言

近日,洋理工大学与上海AI Lab合作研发的EdgeSAM在移动端图像分割领域取得了重大突破。这一优化版Segment Anything Model(SAM)变体在iPhone 14上的运行速度达到了惊人的38 FPS,相比原始SAM快了40倍,为移动设备上的实时交互式图像分割开辟了新天地。

-

Github: https://github.com/chongzhou96/EdgeSAM

-

AI快站模型下载: https://aifasthub.com/models/chongzhou/EdgeSAM

EdgeSAM的创新之举

原始SAM以其强大的性能而闻名,但由于其高昂的计算成本和内存消耗,难以在移动设备上运行。EdgeSAM通过将SAM的基于ViT的图像编码器转化为更适合边缘设备的纯CNN架构,实现了在移动平台上的高效运行,同时基本保持了原模型的性能。

技术优化详解

-

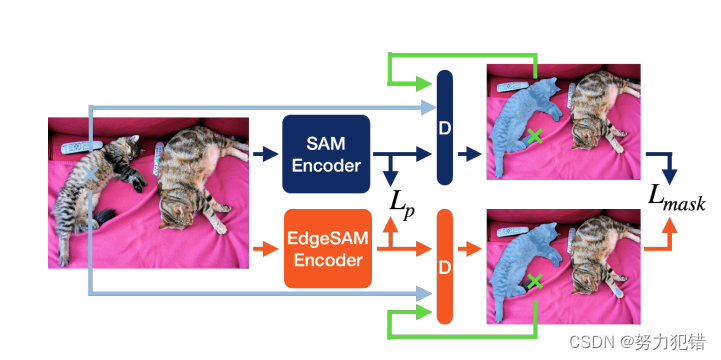

编码器提炼:EdgeSAM通过知识蒸馏技术将SAM的大型ViT图像编码器提炼为一个更紧凑的CNN架构,从而适应边缘设备的运行需求。

-

提示编码器和掩码解码器:在提炼过程中,EdgeSAM包含了提示编码器和掩码解码器,确保了用户输入和掩码生成之间的复杂动态能够被准确捕捉。

-

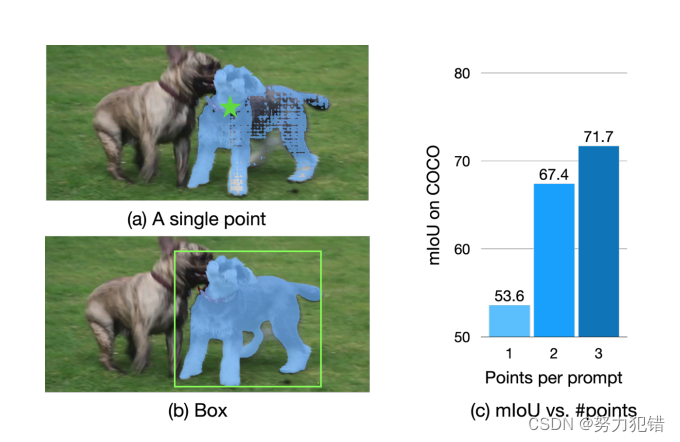

粒度先验模块:为了优化点提示提炼中的数据集偏差问题,EdgeSAM在编码器中加入了轻量级模块,增强了模型对不同提示级别的解释和响应能力。

性能对比

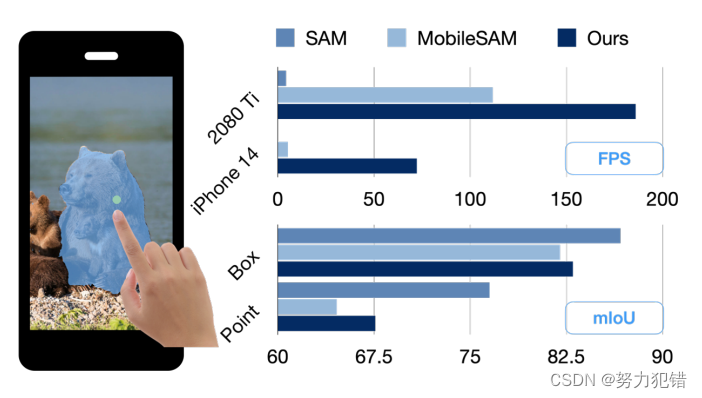

EdgeSAM在多项性能指标上均表现出色,尤其在移动设备上的运行速度方面取得了显著进步。在iPhone 14上,EdgeSAM的图像处理时间仅为14毫秒,比MobileSAM快14倍。在COCO和LVIS数据集上,EdgeSAM的表现与原始SAM相近,甚至在某些方面超越。

应用场景

EdgeSAM的出现使得移动设备上的视频编辑、视频实例分割等应用成为可能。其高速度和高精度的图像处理能力,为移动设备上的实时视觉任务提供了强大的技术支持。

未来展望

EdgeSAM的成功开发不仅是技术创新的胜利,也为移动设备上的实时图像处理和AI应用提供了新的可能性。随着EdgeSAM的持续优化和应用扩展,未来在移动设备上实现更加复杂和高效的图像处理任务将成为现实。

结论

EdgeSAM的推出标志着移动端图像分割技术的一个重要里程碑。它的高效率和优异性能不仅提高了移动设备上图像处理的可能性,也为未来的移动AI应用开启了新的篇章。通过EdgeSAM,用户可以在移动设备上享受到先前只能在高性能计算平台上才能实现的高级图像处理功能,这无疑将推动整个移动应用行业的发展。

参考资料

Github

https://github.com/chongzhou96/EdgeSAM

AI快站模型下载

https://aifasthub.com/models/chongzhou/EdgeSAM

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 攻防技术-单包攻击防范:扫描、畸形、特殊(HCIP)

- 【Web】forward 和 redirect 的区别

- Scikit-Learn线性回归(六)

- 工作记录---项目开发的过程中注意哪些防止网络攻击的手段?

- 自动化运维平台spug

- win10录屏软件大揭秘,看看哪款最适合你!

- 自定义SpringBoot starter

- 洛谷 P8664 [蓝桥杯 2018 省 A] 付账问题

- WEB 3D技术 three.js 设置图像随窗口大小变化而变化

- 5.实现简化版raft协议完成选举