k8s存储卷

容器内的目录和宿主机的目录进行挂载。

容器在系统上的生命周期是短暂的,k8s用控制创建的pod,delete相当于重启,容器的状态也会回复到初始状态。一旦回到初始状态,所有的后来编辑的文件都会消失。

所以需要在容器和节点之间创建一个可以持久化保存容器内文件的存储卷。即使容器被销毁,删除,重启,节点上的存储卷的数据依然存在,后续也I可以继续使用。可以继续将容器内目录和宿主机挂载,继续使用保存的数据。

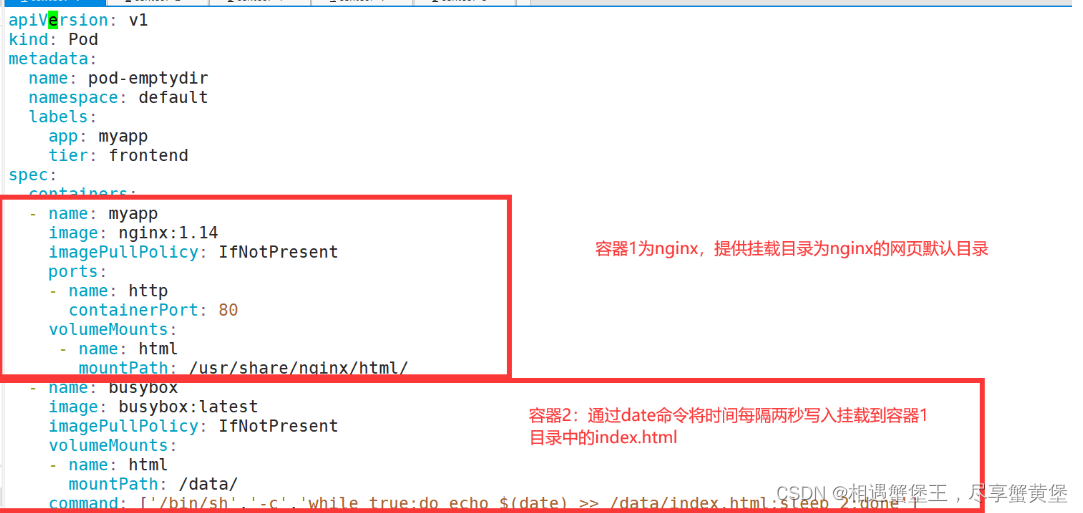

emptyDir存储卷?

当Pod被分配给节点时,首先创建emptyDir卷,并且只要该Pod在该节点上运行,该卷就会存在。正如卷的名字所述,它最初是空的。Pod 中的容器可以读取和写入emptyDir卷中的相同文件,尽管该卷可以挂载到每个容器中的相同或不同路径上。当出于任何原因从节点中删除 Pod 时,emptyDir中的数据将被永久删除。

?emptyDir可实现Pod中的容器之间共享目录数据,但是emptyDir卷不能持久化数据,会随着Pod生命周期结束而一起删除。

mkdir /opt/volumes

cd /opt/volumes

?

vim pod-emptydir.yaml?

apiVersion: v1

kind: Pod

metadata:

? name: pod-emptydir

? namespace: default

? labels:

? ? app: myapp

? ? tier: frontend

spec:

? containers:

? - name: myapp

? ? image: nginx:1.14

? ? imagePullPolicy: IfNotPresent

? ? ports:

? ? - name: http

? ? ? containerPort: 80

?? ?#定义容器挂载内容

? ? volumeMounts:

?? ?#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷

? ? - name: html

?? ? ?#挂载至容器中哪个目录

? ? ? mountPath: /usr/share/nginx/html/

? - name: busybox

? ? image: busybox:latest

? ? imagePullPolicy: IfNotPresent

? ? volumeMounts:

? ? - name: html

?? ? ?#在容器内定义挂载存储名称和挂载路径

? ? ? mountPath: /data/

? ? command: ['/bin/sh','-c','while true;do echo $(date) >> /data/index.html;sleep 2;done']

? #定义存储卷

? volumes:

? #定义存储卷名称 ?

? - name: html

? ? #定义存储卷类型

? ? emptyDir: {}

?? ?

?? ?

kubectl apply -f pod-emptydir.yaml

apiVersion: v1

kind: Pod

metadata:

? name: pod-emptydir

? namespace: default

? labels:

? ? app: myapp

? ? tier: frontend

spec:

? containers:

? - name: myapp

? ? image: nginx:1.14

? ? imagePullPolicy: IfNotPresent

? ? ports:

? ? - name: http

? ? ? containerPort: 80

? ? volumeMounts:

? ? - name: html

? ? ? mountPath: /usr/share/nginx/html/

? - name: busybox

? ? image: busybox:latest

? ? imagePullPolicy: IfNotPresent

? ? volumeMounts:

? ? - name: html

? ? ? mountPath: /data/

? ? command: ['/bin/sh','-c','while true;do echo $(date) >> /data/index.html;sleep 2;done']

? volumes:

? - name: html

? ? emptyDir: {}

?

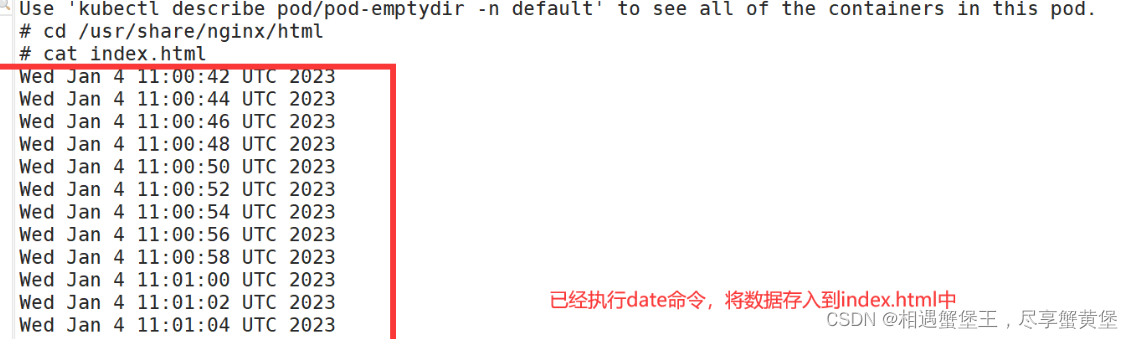

kubectl exec -it pod-emptydir -c myapp bash

cd /usr/share/nginx/html

/usr/share/nginx/html# cat index.html?

?

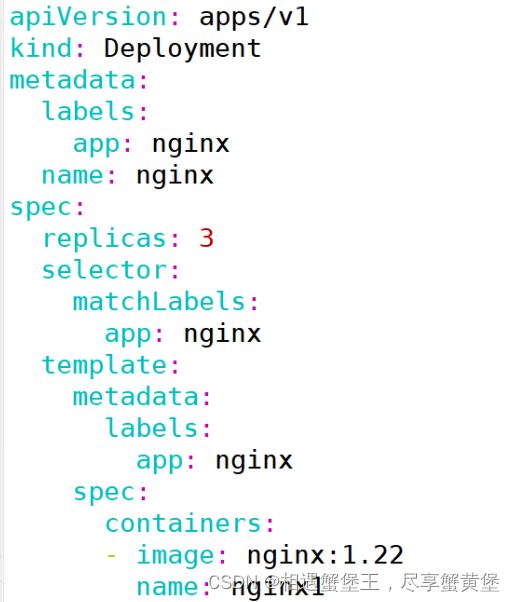

apiVersion: apps/v1

kind: Deployment

metadata:

??labels:

????app: nginx

??name: nginx

spec:

??replicas: 3

??selector:

????matchLabels:

??????app: nginx

??template:

????metadata:

??????labels:

????????app: nginx

????spec:

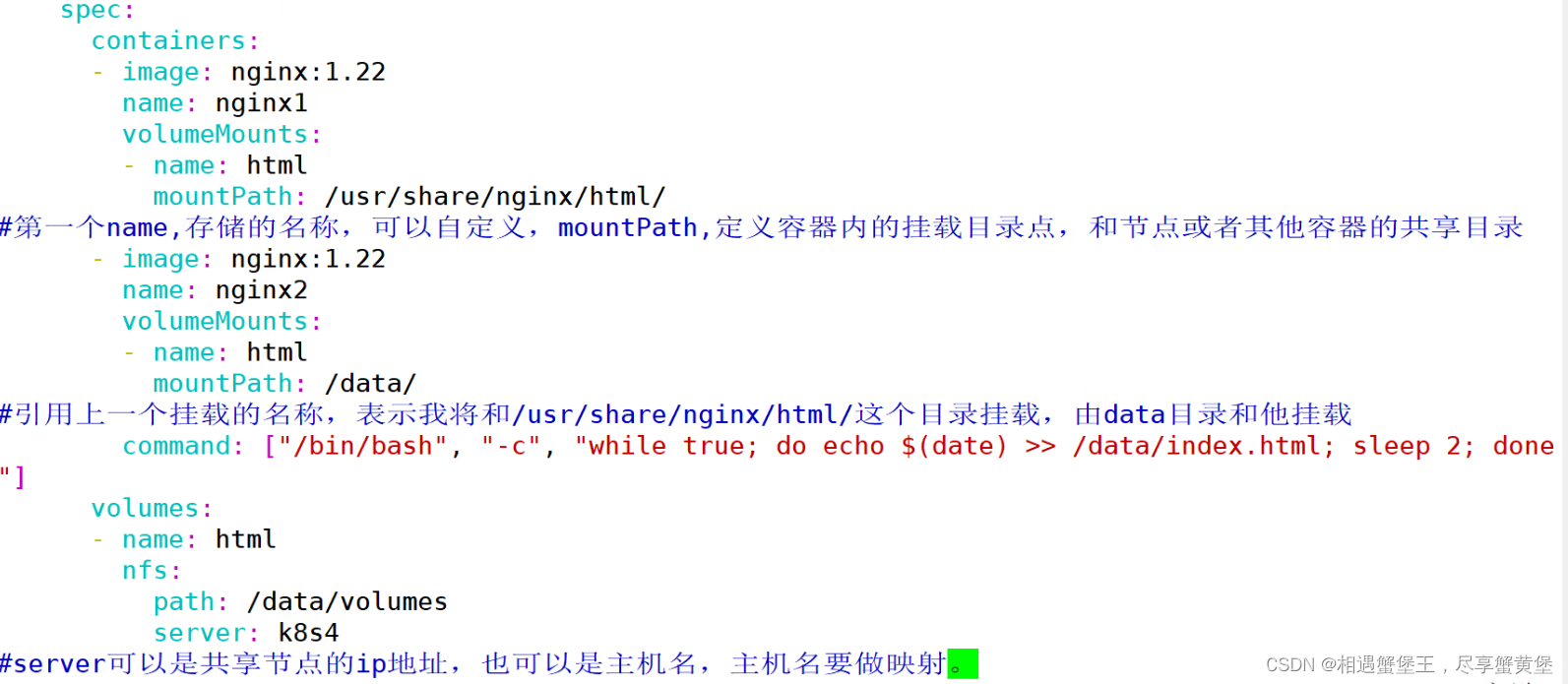

? ? ? containers:

? ? ? - image: nginx:1.22

???? ? ?name: nginx1

???? ? ?volumeMounts:

? ? ? ? - name: html

???????? ?mountPath: /usr/share/nginx/html

? ? ? -?image: nginx:1.22

???? ? ?name: nginx2

???? ? ?volumeMounts:

? ? ? ? - name: html

???????? ?mountPath: /data

???? ? ?command: ["/bin/bash", "-c", "while true; do echo $(date) >> /data/index.html; sleep 2; done"]

? ? ??volumes:

? ? ? - name: html

?????? ?emptyDir: {}

?

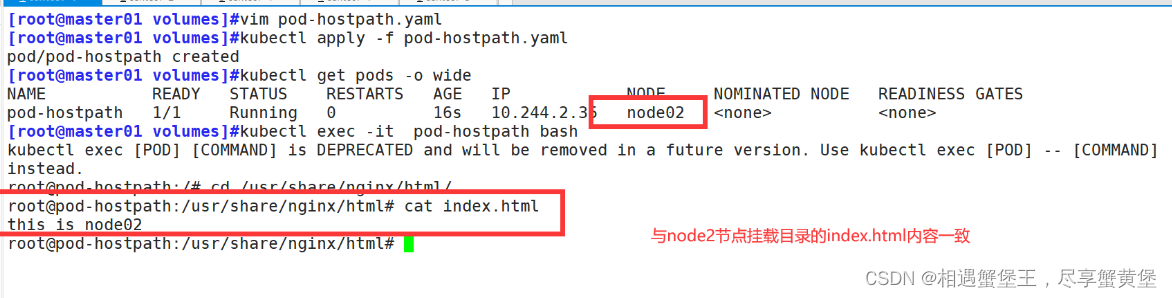

hostPath存储卷

hostPath卷将 node 节点的文件系统中的文件或目录挂载到集群中。

hostPath可以实现持久存储,但是在node节点故障时,也会导致数据的丢失?

把Node节点上的目录/文件挂载到容器中,可实现持久化数据存储。但是存储空间会受到Node节点的单机限制,Node节点故障数据就会丢失,且Pod不能实现跨节点共享数据?

污点设置为NoExecute时,节点上的pod会被驱逐,文件数据在不在?pod被驱逐,并不是node节点被销毁。所有数据还保留在节点上。pod被驱逐(基于控制器创建的)会在其他节点重新部署,又会在其他节点生成一个新的存储卷。数据依然可以持久化。

emptyDir的共享数据,会丢失。

//在 node01 节点上创建挂载目录

mkdir -p /data/pod/volume1

echo 'this is node01' > /data/pod/volume1/index.html

?

//在 node02 节点上创建挂载目录

mkdir -p /data/pod/volume1

echo 'this is node02' > /data/pod/volume1/index.html

?

//创建 Pod 资源

vim pod-hostpath.yaml

apiVersion: v1

kind: Pod

metadata:

? name: pod-hostpath

? namespace: default

spec:

? containers:

? - name: myapp

? ? image: ikubernetes/myapp:v1

?? ?#定义容器挂载内容

? ? volumeMounts:

?? ?#使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷

? ? - name: html

?? ? ?#挂载至容器中哪个目录

? ? ? mountPath: /usr/share/nginx/html

?? ? ?#读写挂载方式,默认为读写模式false

?? ? ?readOnly: false

? #volumes字段定义了paues容器关联的宿主机或分布式文件系统存储卷

? volumes:

? ? #存储卷名称

? ? - name: html

?? ? ?#路径,为宿主机存储路径

? ? ? hostPath:

?? ? ? ?#在宿主机上目录的路径

? ? ? ? ? path: /data/pod/volume1

?? ??? ?#定义类型,这表示如果宿主机没有此目录则会自动创建

? ? ? ? ? type: DirectoryOrCreate

apiVersion: v1

kind: Pod

metadata:

? name: pod-hostpath

? namespace: default

spec:

? containers:

? - name: myapp

? ? image: ikubernetes/myapp:v1

? ? volumeMounts:

? ? - name: html

? ? ? mountPath: /usr/share/nginx/html

? ? ? readOnly: false

? volumes:

? ? - name: html

? ? ? hostPath: ? ? ? ?

? ? ? ? ? path: /data/pod/volume1

? ? ? ? ? type: DirectoryOrCreate

kubectl apply -f pod-hostpath.yaml

kubectl get pods -o wide

apiVersion: apps/v1

kind: Deployment

metadata:

??labels:

????app: nginx

??name: nginx

spec:

??replicas: 3

??selector:

????matchLabels:

??????app: nginx

??template:

????metadata:

??????labels:

????????app: nginx

????spec:

? ? ? containers:

? ? ? - image: nginx:1.22

???? ? ?name: nginx1

???? ? ?volumeMounts:

? ? ? ? - name: html

???????? ?mountPath: /usr/share/nginx/html

? ? ? - image: nginx:1.22

???? ? ?name: nginx2

???? ? ?volumeMounts:

? ? ? ? - name: html

???????? ?mountPath: /data

???? ? ?command: ["/bin/bash", "-c", "while true; do echo $(date) >> /data/index.html; sleep 2; done"]

? ? ??volumes:

? ? ? - name: html

?????? ?hostPath:

? ? ? ? ? path: /opt/test

? ? ? ? ? type: DirectoryOrCreate

mkdir /opt/volumes

cd /opt/volumes

[root@master volumes]# vim?hostPath-demo.yaml?

apiVersion: v1

kind: Pod

metadata:

? name: hostpath-pod-demo

? namespace: default

spec:

? containers:

? - name: myapp

? ? image: ikubernetes/myapp:v1

? ? volumeMounts:

? ? - name: html

? ? ? mountPath: /usr/share/nginx/html

? volumes:

? ? - name: html

? ? ? hostPath:

? ? ? ? path: /data/pod/volume1

? ? ? ? type: DirectoryOrCreate

[root@node01 ~]# mkdir -p /data/pod/volume1

[root@node01 ~]# vim /data/pod/volume1/index.html

node1

[root@node02 ~]# mkdir -p /data/pod/volume1

[root@node02 ~]# vim /data/pod/volume1/index.html

node2

[root@master volumes]# kubectl apply -f hostPath-demo.yaml?

pod/hostpath-pod-demo created

[root@master volumes]# kubectl get pods -o wide

NAME ? ? ? ? ? ? ? ?READY ? STATUS ? ?RESTARTS ? AGE ? IP ? ? ? ? ? ? ? NODE ? ? NOMINATED NODE ? READINESS GATES

hostpath-pod-demo ? 1/1 ? ? Running ? 0 ? ? ? ? ?38s ? 10.101.231.178 ? node02 ? <none> ? ? ? ? ? <none>

[root@master volumes]# curl 10.101.231.178

node02

[root@master volumes]# kubectl delete -f hostPath-demo.yaml ? ? ?

pod "hostpath-pod-demo" deleted

[root@master volumes]# kubectl apply -f hostPath-demo.yaml ? ? ??

pod/hostpath-pod-demo created

[root@master volumes]# kubectl get pods -o wide

NAME ? ? ? ? ? ? ? ?READY ? STATUS ? ?RESTARTS ? AGE ? IP ? ? ? ? ? ? ? NODE ? ? NOMINATED NODE ? READINESS GATES

hostpath-pod-demo ? 1/1 ? ? Running ? 0 ? ? ? ? ?15s ? 10.101.231.179 ? node02 ? <none> ? ? ? ? ? <none>

[root@master volumes]# curl 10.101.231.179

node02

nfs共享存储卷

使用nfs服务将共享存储设备空间挂载到容器中,可实现持久化数据存储,且Pod能实现跨节点共享数据?

//在stor01节点上安装nfs,并配置nfs服务

mkdir /data/volumes -p

chmod 777 /data/volumes

?

vim /etc/exports

/data/volumes 192.168.73.0/24(rw,no_root_squash)

?

systemctl start rpcbind

systemctl start nfs

?

showmount -e

Export list for stor01:

/data/volumes 192.168.73.0/24

?

?

//master节点操作

vim pod-nfs-vol.yaml

apiVersion: v1

kind: Pod

metadata:

? name: pod-vol-nfs

? namespace: default

spec:

? containers:

? - name: myapp

? ? image: ikubernetes/myapp:v1

? ? volumeMounts:

? ? - name: html

? ? ? mountPath: /usr/share/nginx/html

? volumes:

? ? - name: html

? ? ? nfs:

? ? ? ? path: /data/volumes

? ? ? ? server: stor01

?

kubectl apply -f pod-nfs-vol.yaml

PVC 和 PV的静态存储卷

?PV 全称叫做 Persistent Volume,持久化存储卷。它是用来描述或者说用来定义一个存储卷的,这个通常都是由运维工程师来定义。

PVC 的全称是 Persistent Volume Claim,是持久化存储的请求。它是用来描述希望使用什么样的或者说是满足什么条件的 PV 存储。

PVC 的使用逻辑:在 Pod 中定义一个存储卷(该存储卷类型为 PVC),定义的时候直接指定大小,PVC 必须与对应的 PV 建立关系,PVC 会根据配置的定义去 PV 申请,而 PV 是由存储空间创建出来的。PV 和 PVC 是 Kubernetes 抽象出来的一种存储资源。

PV是集群中的资源。 PVC是对这些资源的请求,也是对资源的索引检查。

?pvc 和pv的创建过程及销毁过程

?PV和PVC之间的相互作用遵循这个生命周期:

Provisioning(配置)---> Binding(绑定)---> Using(使用)---> Releasing(释放) ---> Recycling(回收)

?●Provisioning,即 PV 的创建,可以直接创建 PV(静态方式),也可以使用 StorageClass 动态创建

●Binding,将 PV 分配给 PVC

●Using,Pod 通过 PVC 使用该 Volume,并可以通过准入控制StorageProtection(1.9及以前版本为PVCProtection) 阻止删除正在使用的 PVC

●Releasing,Pod 释放 Volume 并删除 PVC

●Reclaiming,回收 PV,可以保留 PV 以便下次使用,也可以直接从云存储中删除

根据这 5 个阶段,PV 的状态有以下 4 种:

●Available(可用):表示可用状态,还未被任何 PVC 绑定

●Bound(已绑定):表示 PV 已经绑定到 PVC

●Released(已释放):表示 PVC 被删掉,但是资源尚未被集群回收

●Failed(失败):表示该 PV 的自动回收失败

?一个PV从创建到销毁的具体流程如下:

一个PV创建完后状态会变成Available,等待被PVC绑定。

一旦被PVC邦定,PV的状态会变成Bound,就可以被定义了相应PVC的Pod使用。

Pod使用完后会释放PV,PV的状态变成Released。

变成Released的PV会根据定义的回收策略做相应的回收工作。有三种回收策略,Retain、Delete和Recycle。Retain就是保留现场,K8S集群什么也不做,等待用户手动去处理PV里的数据,处理完后,再手动删除PV。Delete策略,K8S会自动删除该PV及里面的数据。Recycle方式,K8S会将PV里的数据删除,然后把PV的状态变成Available,又可以被新的PVC绑定使用。?

对pv的操作指导

kubectl explain pv ? ?#查看pv的定义方式

FIELDS:

?? ?apiVersion: v1

?? ?kind: PersistentVolume

?? ?metadata: ? ?#由于 PV 是集群级别的资源,即 PV 可以跨 namespace 使用,所以 PV 的 metadata 中不用配置 namespace

?? ? ?name:?

?? ?spec

?? ?

kubectl explain pv.spec ? ?#查看pv定义的规格

spec:

? nfs:(定义存储类型)

? ? path:(定义挂载卷路径)

? ? server:(定义服务器名称)

? accessModes:(定义访问模型,有以下三种访问模型,以列表的方式存在,也就是说可以定义多个访问模式)

? ? - ReadWriteOnce ? ? ? ? ?#(RWO)存储可读可写,但只支持被单个 Pod 挂载

?? ?- ReadOnlyMany ? ? ? ? ? #(ROX)存储可以以只读的方式被多个 Pod 挂载

?? ?- ReadWriteMany ? ? ? ? ?#(RWX)存储可以以读写的方式被多个 Pod 共享

#nfs 支持全部三种;iSCSI 不支持 ReadWriteMany(iSCSI 就是在 IP 网络上运行 SCSI 协议的一种网络存储技术);HostPath 不支持 ReadOnlyMany 和 ReadWriteMany。

iscsiadm -m session -P 3

iscsiadm查看服务器是否有iscsi设备-m session:指定操作的会话模块,管理iscsi的会话-P3:显示详细信息的级别。级别就是3.显示详细信息。

?

capacity:(定义存储能力,一般用于设置存储空间)

storage: 2Gi (指定大小)

? storageClassName: (自定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)

? persistentVolumeReclaimPolicy: Retain ? ?

#回收策略(Retain/Delete/Recycle)

#Retain(保留):当删除与之绑定的PVC时候,这个PV被标记为released(PVC与PV解绑但还没有执行回收策略)且之前的数据依然保存在该PV上,但是该PV不可用,需要手动来处理这些数据并删除该PV。

#Delete(删除):删除与PV相连的后端存储资源(只有 AWS EBS, GCE PD, Azure Disk 和 Cinder 支持)

#Recycle(回收):删除数据,效果相当于执行了 rm -rf /thevolume/* (只有 NFS 和 HostPath 支持)

?

kubectl explain pvc ? #查看PVC的定义方式

KIND: ? ? PersistentVolumeClaim

VERSION: ?v1

FIELDS:

? ?apiVersion?? ?<string>

? ?kind?? ?<string> ?

? ?metadata?? ?<Object>

? ?spec?? ?<Object>

?

#PV和PVC中的spec关键字段要匹配,比如存储(storage)大小、访问模式(accessModes)、存储类名称(storageClassName)

kubectl explain pvc.spec

spec:

? accessModes: (定义访问模式,必须是PV的访问模式的子集)

? resources:

? ? requests:

? ? ? storage: (定义申请资源的大小)

? storageClassName: (定义存储类名称,此配置用于绑定具有相同类别的PVC和PV)

静态创建pv和pvc资源由pod运用过程

我们将选择一台k8s集群之外的服务器作为NFS共享存储服务器,并且按照图中的规格

创建pv,再由k8s集群创建pv资源和pvc资源,最后将其挂载在pod上进行使用

在NFS主机上创建共享目录,并且进行exportfs发布?

#创建共享目录

mkdir -p /data/vulumes/v{1..5}

#进行exports共项目录的编辑

vim /etc/exports

/data/vulumes/v1 192.168.73.0/24(rw,sync,no_root_squash)

/data/vulumes/v2 192.168.73.0/24(rw,sync,no_root_squash)

/data/vulumes/v3 192.168.73.0/24(rw,sync,no_root_squash)

/data/vulumes/v4 192.168.73.0/24(rw,sync,no_root_squash)

/data/vulumes/v5 192.168.73.0/24(rw,sync,no_root_squash)

#发布共享目录

exportfs -avf

在master主机编写pv资源创建yaml?

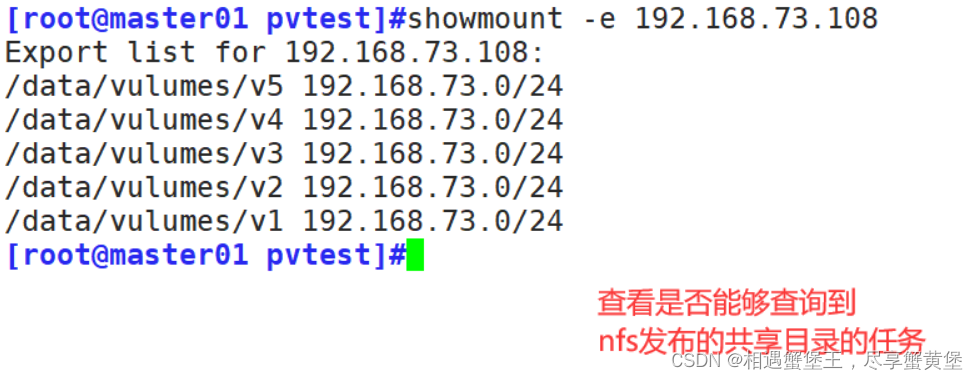

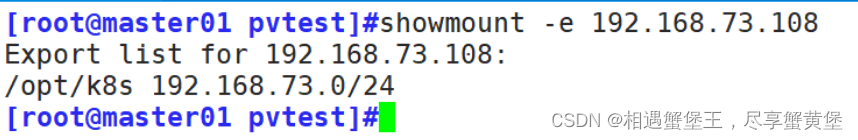

showmounte -e 192.168.73.108

vim pv-demo.yaml

---

apiVersion: v1

kind: PersistentVolume

metadata:

? name: pv0001

spec:

? capacity:

? ? storage: 1Gi

? volumeMode: Filesystem

? accessModes:

? ? - ReadWriteOnce

? ? - ReadWriteMany

? persistentVolumeReclaimPolicy: Recycle

? nfs:

? ? path: /data/vulumes/v1

? ? server: 192.168.73.108

---

apiVersion: v1

kind: PersistentVolume

metadata:

? name: pv0002

spec:

? capacity:

? ? storage: 2Gi

? volumeMode: Filesystem

? accessModes:

? ? - ReadWriteOnce

? persistentVolumeReclaimPolicy: Recycle

? nfs:

? ? path: /data/vulumes/v2

? ? server: 192.168.73.108

---

apiVersion: v1

kind: PersistentVolume

metadata:

? name: pv0003

spec:

? capacity:

? ? storage: 2Gi

? volumeMode: Filesystem

? accessModes:

? ? - ReadWriteOnce

? ? - ReadWriteMany

? persistentVolumeReclaimPolicy: Recycle

? nfs:

? ? path: /data/vulumes/v3

? ? server: 192.168.73.108

---

apiVersion: v1

kind: PersistentVolume

metadata:

? name: pv0004

spec:

? capacity:

? ? storage: 4Gi

? volumeMode: Filesystem

? accessModes:

? ? - ReadWriteOnce

? ? - ReadWriteMany

? persistentVolumeReclaimPolicy: Recycle

? nfs:

? ? path: /data/vulumes/v4

? ? server: 192.168.73.108

---

apiVersion: v1

kind: PersistentVolume

metadata:

? name: pv0005

spec:

? capacity:

? ? storage: 5Gi

? volumeMode: Filesystem

? accessModes:

? ? - ReadWriteOnce

? ? - ReadWriteMany

? persistentVolumeReclaimPolicy: Recycle

? nfs:

? ? path: /data/vulumes/v5

? ? server: 192.168.73.108

?

kubectl apply -f pv-demo.yaml

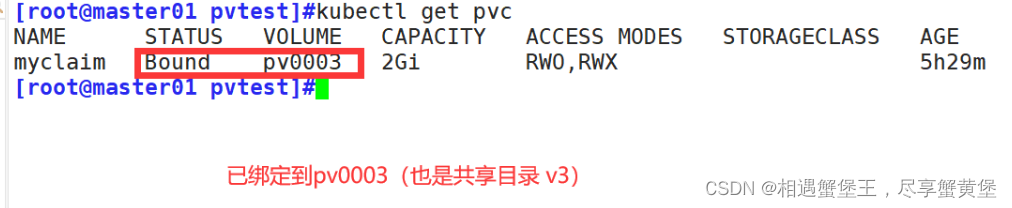

创建pvc资源,并且设置匹配绑定相应的pv?

vim pvc-demo.yaml

?

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

? name: myclaim

spec:

? accessModes:

? ? - ReadWriteMany

? resources:

? ? requests:

? ? ? storage: 2Gi

?

kubectl apply -f pvc-demo.yaml

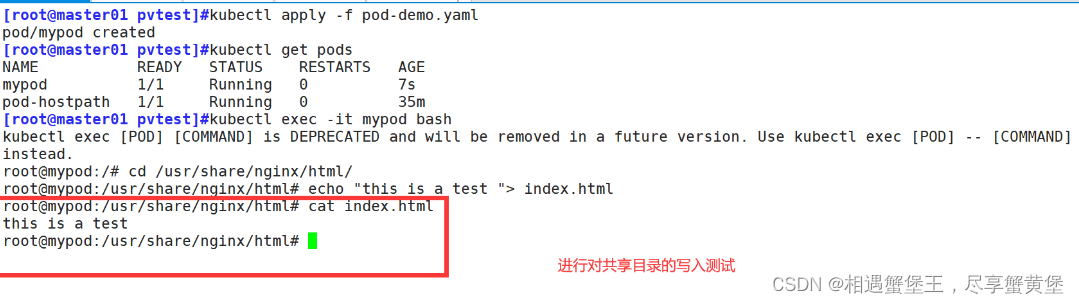

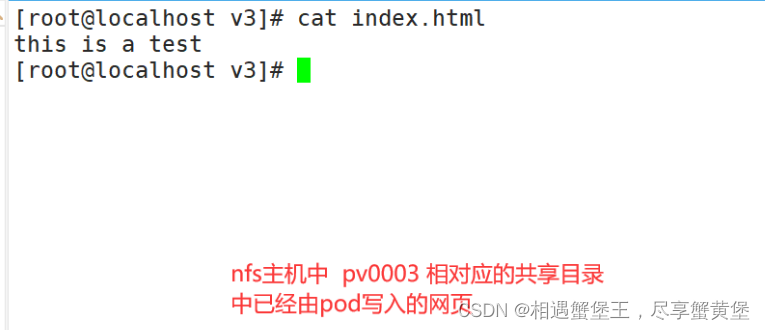

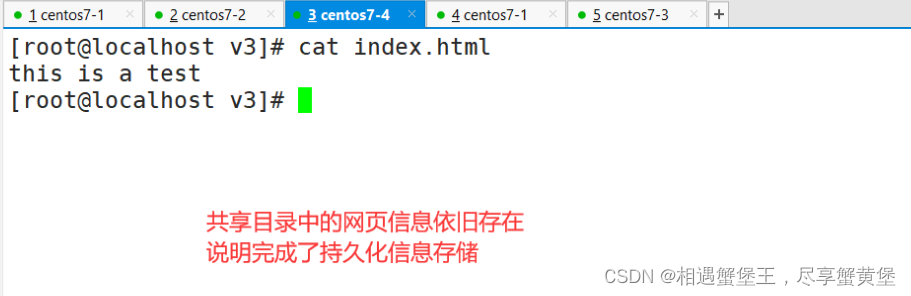

创建pod,挂载共享卷,并且进行共享目录写入测试?

apiVersion: v1

kind: Pod

metadata:

? name: mypod

spec:

? containers:

? ? - name: myapp

? ? ? image: nginx:1.14

? ? ? volumeMounts:

? ? ? - mountPath: "/usr/share/nginx/html"

? ? ? ? name: mypd

? volumes:

? ? - name: mypd

? ? ? persistentVolumeClaim:

? ? ? ? claimName: myclaim

?

kubectl apply -f pod-demo.yaml?

StorageClass + nfs-client-provisioner搭建动态创建pv

上面介绍的PV和PVC模式是需要运维人员先创建好PV,然后开发人员定义好PVC进行一对一的Bond,但是如果PVC请求成千上万,那么就需要创建成千上万的PV,对于运维人员来说维护成本很高,Kubernetes提供一种自动创建PV的机制,叫StorageClass,它的作用就是创建PV的模板。

创建 StorageClass 需要定义 PV 的属性,比如存储类型、大小等;另外创建这种 PV 需要用到的存储插件,比如 Ceph 等。 有了这两部分信息,Kubernetes 就能够根据用户提交的 PVC,找到对应的 StorageClass,然后 Kubernetes 就会调用 StorageClass 声明的存储插件,自动创建需要的 PV 并进行绑定。

Kubernetes 本身支持的动态 PV 创建不包括 NFS,所以需要使用外部存储卷插件分配PV。

卷插件称为 Provisioner(存储分配器),NFS 使用的是 nfs-client,这个外部卷插件会使用已经配置好的 NFS 服务器自动创建 PV。

Provisioner:用于指定 Volume 插件的类型,包括内置插件(如 kubernetes.io/aws-ebs)和外部插件(如 external-storage 提供的 ceph.com/cepfs)。

?

在stor01节点上安装nfs,并配置nfs服务

mkdir /opt/k8s

chmod 777 /opt/k8s/

?

vim /etc/exports

/opt/k8s 192.168.73.0/24(rw,no_root_squash,sync)

?

systemctl restart nfs

创建 Service Account,用来管理 NFS Provisioner 在?k8s?集群中运行的权限和动态规则

vim nfs-client-rbac.yaml

#创建 Service Account 账户,用来管理 NFS Provisioner 在 k8s 集群中运行的权限

apiVersion: v1

kind: ServiceAccount

metadata:

? name: nfs-client-provisioner

---

#创建集群角色

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

? name: nfs-client-provisioner-clusterrole

rules:

? - apiGroups: [""]

? ? resources: ["persistentvolumes"]

? ? verbs: ["get", "list", "watch", "create", "delete"]

? - apiGroups: [""]

? ? resources: ["persistentvolumeclaims"]

? ? verbs: ["get", "list", "watch", "update"]

? - apiGroups: ["storage.k8s.io"]

? ? resources: ["storageclasses"]

? ? verbs: ["get", "list", "watch"]

? - apiGroups: [""]

? ? resources: ["events"]

? ? verbs: ["list", "watch", "create", "update", "patch"]

? - apiGroups: [""]

? ? resources: ["endpoints"]

? ? verbs: ["create", "delete", "get", "list", "watch", "patch", "update"]

---

#集群角色绑定

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

? name: nfs-client-provisioner-clusterrolebinding

subjects:

- kind: ServiceAccount

? name: nfs-client-provisioner

? namespace: default

roleRef:

? kind: ClusterRole

? name: nfs-client-provisioner-clusterrole

? apiGroup: rbac.authorization.k8s.io

?

?

kubectl apply -f nfs-client-rbac.yaml

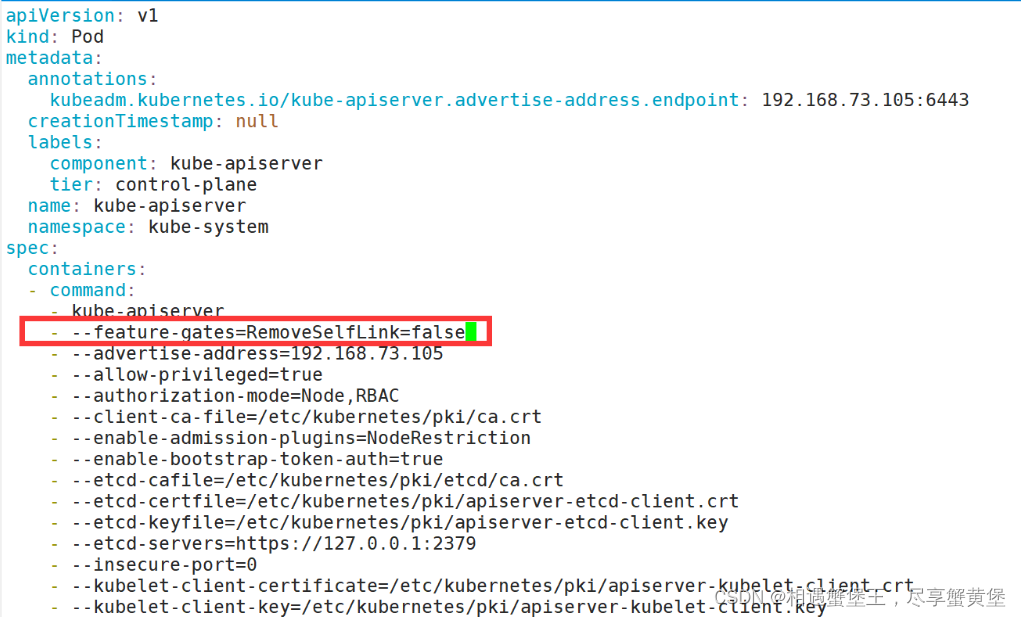

使用 Deployment 来创建 NFS Provisioner

vim /etc/kubernetes/manifests/kube-apiserver.yaml

spec:

? containers:

? - command:

? ? - kube-apiserver

? ? - --feature-gates=RemoveSelfLink=false ? ? ? #添加这一行

? ? - --advertise-address=192.168.73.105

......

?

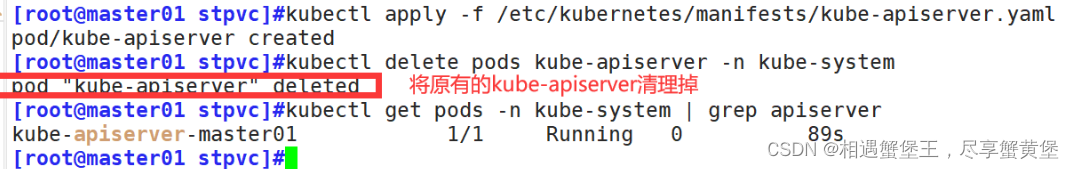

kubectl apply -f /etc/kubernetes/manifests/kube-apiserver.yaml

kubectl delete pods kube-apiserver -n kube-system?

kubectl get pods -n kube-system | grep apiserver

?

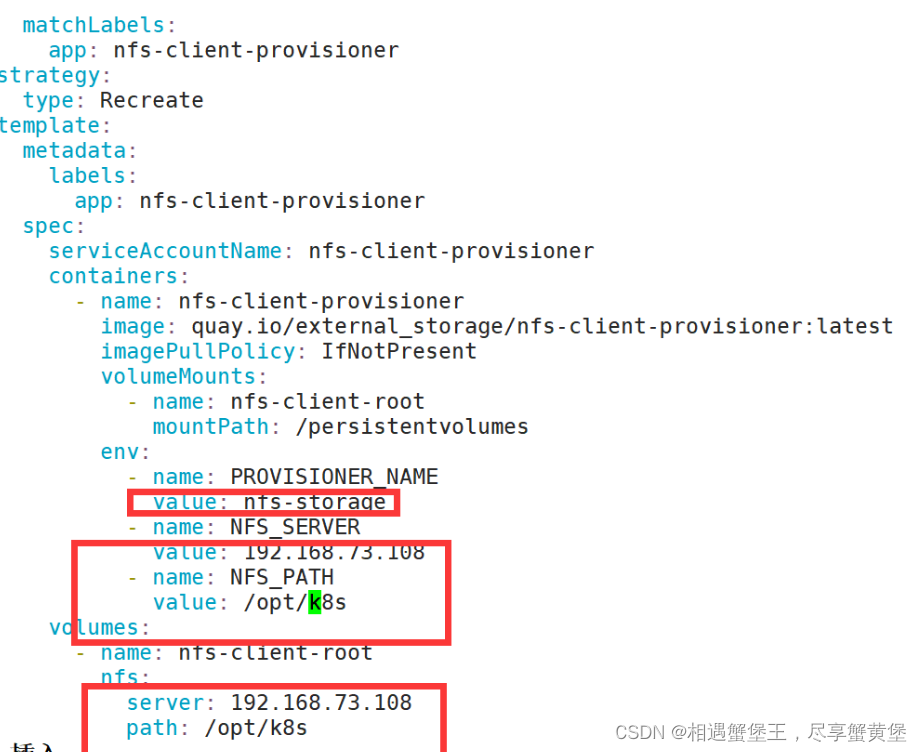

#创建 NFS Provisioner

vim nfs-client-provisioner.yaml

kind: Deployment

apiVersion: apps/v1

metadata:

? name: nfs-client-provisioner

spec:

? replicas: 1

? selector:

? ? matchLabels:

? ? ? app: nfs-client-provisioner

? strategy:

? ? type: Recreate

? template:

? ? metadata:

? ? ? labels:

? ? ? ? app: nfs-client-provisioner

? ? spec:

? ? ? serviceAccountName: nfs-client-provisioner ? ?? ? ?#指定Service Account账户

? ? ? containers:

? ? ? ? - name: nfs-client-provisioner

? ? ? ? ? image: quay.io/external_storage/nfs-client-provisioner:latest

? ? ? ? ? imagePullPolicy: IfNotPresent

? ? ? ? ? volumeMounts:

? ? ? ? ? ? - name: nfs-client-root

? ? ? ? ? ? ? mountPath: /persistentvolumes

? ? ? ? ? env:

? ? ? ? ? ? - name: PROVISIONER_NAME

? ? ? ? ? ? ? value: nfs-storage ? ? ? #配置provisioner的Name,确保该名称与StorageClass资源中的provisioner名称保持一致

? ? ? ? ? ? - name: NFS_SERVER

? ? ? ? ? ? ? value: stor01 ? ? ? ? ? #配置绑定的nfs服务器

? ? ? ? ? ? - name: NFS_PATH

? ? ? ? ? ? ? value: /opt/k8s ? ? ? ? ?#配置绑定的nfs服务器目录

? ? ? volumes: ? ? ? ? ? ? ?#申明nfs数据卷

? ? ? ? - name: nfs-client-root

? ? ? ? ? nfs:

? ? ? ? ? ? server: stor01

? ? ? ? ? ? path: /opt/k8s

?? ?

?? ?

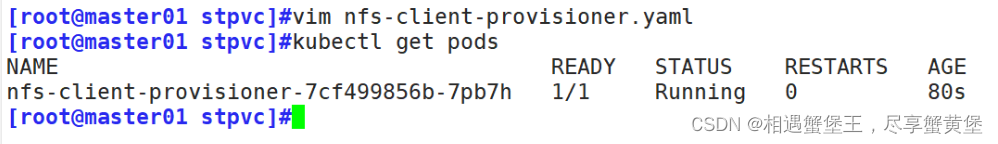

kubectl apply -f nfs-client-provisioner.yaml?

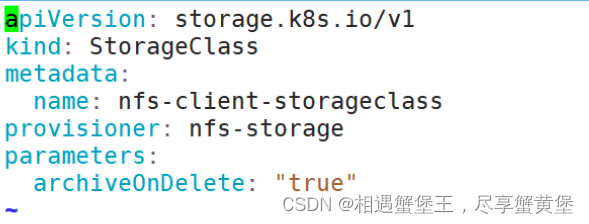

创建 StorageClass,负责建立 PVC 并调用 NFS provisioner 进行预定的工作,并让 PV 与 PVC 建立关联

vim nfs-client-storageclass.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:

? name: nfs-client-storageclass

provisioner: nfs-storage ? ? #这里的名称要和provisioner配置文件中的环境变量PROVISIONER_NAME保持一致

parameters:

? archiveOnDelete: "false" ? #false表示在删除PVC时不会对数据目录进行打包存档,即删除数据;为ture时就会自动对数据目录进行打包存档,存档文件以archived开头

??

??

kubectl apply -f nfs-client-storageclass.yaml

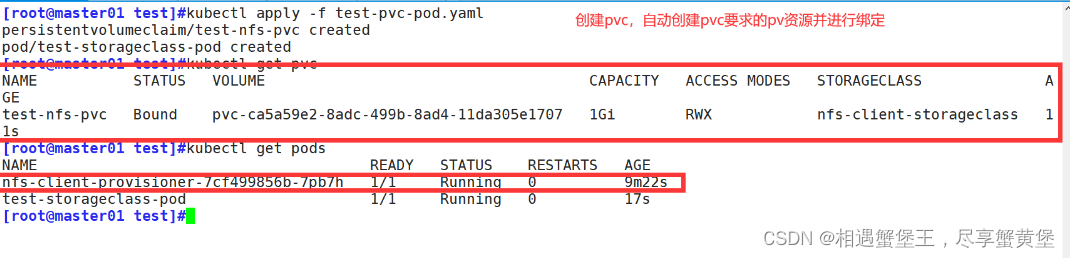

创建 PVC 和 Pod 测试

vim test-pvc-pod.yaml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

? name: test-nfs-pvc

? #annotations: volume.beta.kubernetes.io/storage-class: "nfs-client-storageclass" ? ? #另一种SC配置方式

spec:

? accessModes:

? ? - ReadWriteMany

? storageClassName: nfs-client-storageclass ? ?#关联StorageClass对象

? resources:

? ? requests:

? ? ? storage: 1Gi

---

apiVersion: v1

kind: Pod

metadata:

? name: test-storageclass-pod

spec:

? containers:

? - name: busybox

? ? image: busybox:latest

? ? imagePullPolicy: IfNotPresent

? ? command:

? ? - "/bin/sh"

? ? - "-c"

? ? args:

? ? - "sleep 3600"

? ? volumeMounts:

? ? - name: nfs-pvc

? ? ? mountPath: /mnt

? restartPolicy: Never

? volumes:

? - name: nfs-pvc

? ? persistentVolumeClaim:

? ? ? claimName: test-nfs-pvc ? ? ?#与PVC名称保持一致

?? ? ?

?? ? ?

kubectl apply -f test-pvc-pod.yaml

总结

静态PV的使用:

1、准备好存储设备和共享目录

2、创建PV资源,配置存储卷类型、访问模式(RWX,RWO,ROX)、存储能力大小

3、创建PVC资源,配置请求PV资源的访问模式和存储大小,绑定PV(一个PV只能绑定一个PVC)

4、创建Pod资源挂载PVC,配置存储卷类型为persistentVolumeClaim,在容器配置中定义存储卷挂载内容

StorageClass 简称 SC 资源 实现动态创建 PV 资源

StorageClass :可以调用指定的存储卷插件(provisioner),根据PVC的请求内容动态创建PV资源,使PV与PVC绑定

provisioner :在存储设备上创建PV资源的卷所使用的目录,将PV与卷目录建立关联

StorageClass + nfs-client-provisioner 动态创建PV:

1、准备好NFS服务器和共享目录

2、创建service account服务账户和RBAC授权,使得sa服务账户具有对PV,PVC,SC等资源的操作权限

3、创建nfs-client-provisioner存储卷插件Pod,配置中使用之前授权过的sa服务账户,设置环境变量定义provisioner的名称及NFS服务器地址和共享目录路径

4、创建StorageClass资源,配置中使用之前定义provisioner的名称

------------- 以上过程是一劳永逸的,以后只需要创建PVC就可以动态生成相关PV资源 -------------

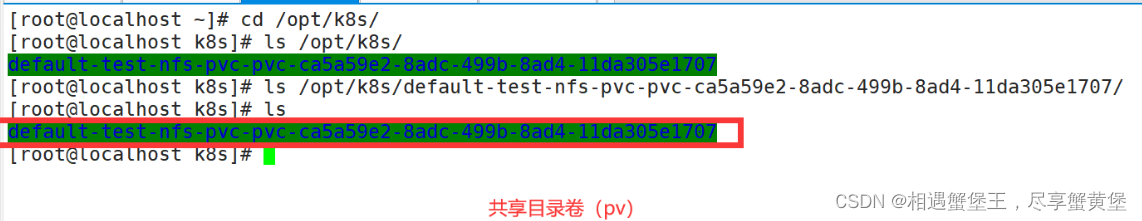

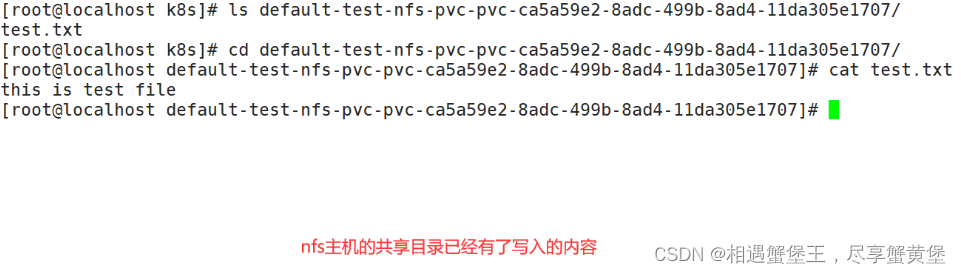

5、创建PVC资源,配置中关联StorageClass资源。创建PVC资源后会在NFS服务器上自动生成相关的PV使用的目录,目录名以<pvc的namespace_name>-<pvc_name>-<pv_name>格式命名

6、创建Pod资源,配置存储卷类型为persistentVolumeClaim,在容器配置中定义存储卷挂载内容

?

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 本地安装配置禅道BUG管理系统并结合内网穿透实现公网访问管理界面

- Vue 3.2 源码系列(Vue.js的设计与实现)01-命令式VS声明式

- AcWing算法提高课-4.1.3程序自动分析

- 图片压缩技巧:缩小证件照文件大小至200KB的步骤

- Yearning front 任意文件读取漏洞复现

- Notepad++批量更改文件编码格式及文档格式

- 【深度学习:Self-supervised learning (SSL) 】自我监督学习解释

- Steam注册教程(2024最新版),适合新手小白

- 使用MySQL的过程中,有没有遇到过count()比较慢的情况?

- Java经典框架之Spring