大数据技术原理及应用课实验7 :Spark初级编程实践

发布时间:2024年01月22日

实验7 Spark初级编程实践

一、实验目的

1. 掌握使用Spark访问本地文件和HDFS文件的方法

2. 掌握Spark应用程序的编写、编译和运行方法

二、实验平台

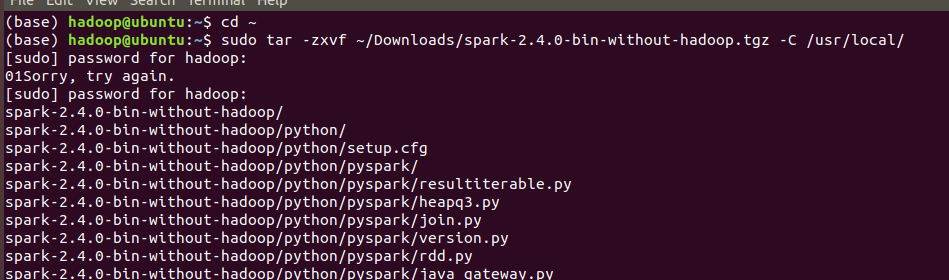

1. 操作系统:Ubuntu18.04(或Ubuntu16.04);

2. Spark版本:2.4.0;

3. Hadoop版本:3.1.3。

三、实验步骤(每个步骤下均需有运行截图)

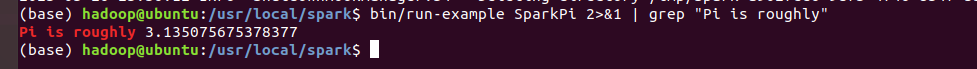

实验前期准备:

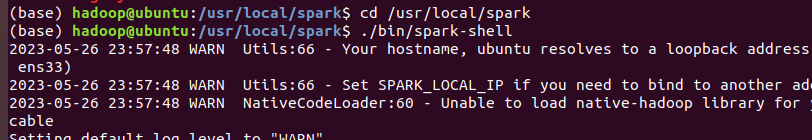

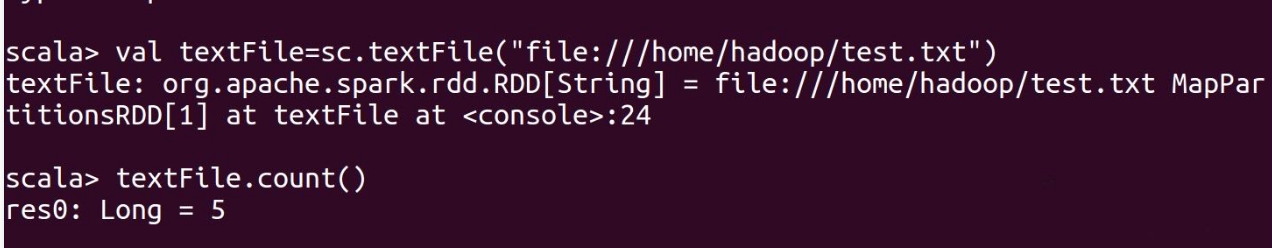

1. Spark读取文件系统的数据

(1)在spark-shell中读取Linux系统本地文件“/home/hadoop/test.txt”,然后统计出文件的行数;

(2)在spark-shell中读取HDFS系统文件“/user/hadoop/test.txt”(如果该文件不存在,请先创建),然后,统计出文件的行数;

文章来源:https://blog.csdn.net/weixin_60530224/article/details/135633670

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:chenni525@qq.com进行投诉反馈,一经查实,立即删除!

最新文章

- Python教程

- 深入理解 MySQL 中的 HAVING 关键字和聚合函数

- Qt之QChar编码(1)

- MyBatis入门基础篇

- 用Python脚本实现FFmpeg批量转换

- 从零学算法94

- ubuntu20.04一键通过docker-compose部署mysql 8.0.20

- Django 4.2.7 ORM 连接MySQLServer 完成单表CRUD

- 【OpenVINO】 使用 OpenVINO CSharp API 部署 PaddleOCR 项目介绍

- Java什么是缓存穿透?怎么解决?

- 前端八股文(HTML篇)二

- 【ITK库学习】使用itk库进行图像配准:内插器(插值)

- 用友crm客户关系管理pub/help2.php接口任意文件读取漏洞复现 [附POC]

- 《 乱弹篇(四)》

- sql如何获取字段是数组中的数字【搬代码】